La strada vero quello che viene definito apprendimento automatico continuo e quindi verso un’intelligenza artificiale che sia sostenibile, oltre che efficiente ed equa, è ancora lunga. La buona notizia è che l’Italia è tra i protagonisti di questo importante cambiamento di paradigma.

Impatto ambientale: la grande sfida dell’Intelligenza artificiale

Indice degli argomenti

L’insostenibile rigidità degli attuali sistemi di intelligenza artificiale

L’intelligenza artificiale costituisce oggi una tecnologia abilitante per applicazioni che avremmo considerato impossibili da realizzare appena una decina di anni fa, o che, parafrasando Arthur C. Clarke, avremmo probabilmente ritenuto “indistinguibili dalla magia”. Dall’interazione vocale con gli oggetti intorno a noi alle macchine a guida autonoma, la repentina accelerazione della ricerca, e la subitanea e pervasiva applicazione della stessa negli ambiti più disparati, ha suscitato un rinnovato interesse nella disciplina, tale da considerarla paragonabile, in termini di impatto, alla scoperta del fuoco o del motore a vapore.

Tuttavia, tali sviluppi, principalmente legati a (recenti) significativi progressi nell’ambito dell’apprendimento automatico, sebbene al centro della rivoluzione digitale d’oggi e dei suoi effetti benefici su società e mercati, risultano basati su paradigmi computazionali spesso insostenibili nel lungo periodo.

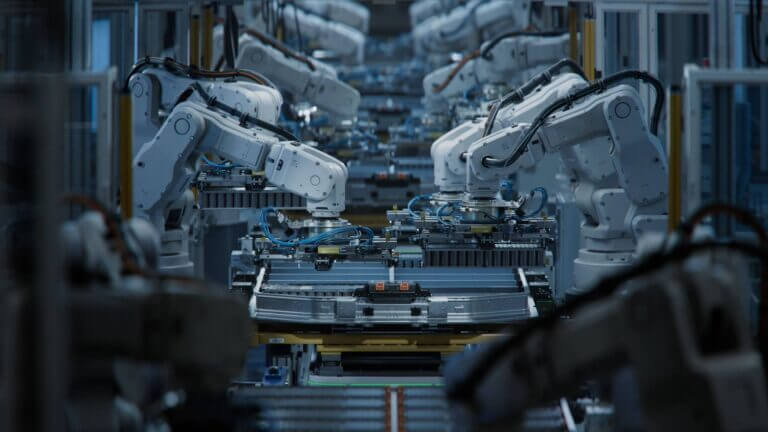

I più moderni sistemi di intelligenza artificiale, infatti, risultano particolarmente rigidi nell’applicazione delle loro capacità a condizioni nuove, non precedentemente affrontate durante il loro processo di addestramento, fallendo, spesso, clamorosamente[1]. A differenza dell’apprendimento biologico, come ad esempio quello del cervello umano (ad oggi il sistema intelligente più efficiente ed efficace conosciuto), non sono in grado di apprendere continuamente, adattandosi rapidamente alle situazioni contingenti.

L’unico modo per simulare una tale capacità di adattamento risulta il crescente accumulo di titaniche quantità di dati ed il frequente riaddestramento da zero di tali sistemi che, nei casi più eclatanti, necessiterebbero più di 300 anni su un singolo calcolatore ed un costo stimato nell’ordine dei milioni di euro laddove invece li si addestri mediante massicce infrastrutture di calcolo parallelo[2]. Ma l’aspetto più inquietante è l’evidente consumo di energia e conseguente emissione globale di CO2 pari o superiore a quella emessa da un’automobile durante il suo intero ciclo di vita[3].

La sostenibilità dell’IA comincia suscitare interesse

È come se, per ogni nuovo giorno vissuto, fossimo costretti a rivivere la nostra intera vita trascorsa fino a quell’istante: stancante, non trovate? Ciò nonostante, nella scapicollata rincorsa ai servizi e prodotti di IA all’ultimo grido, la variabile “sostenibilità” acquista spesso un titolo secondario.

Sebbene sin dagli albori dell’intelligenza artificiale si sia sempre concepita, se non auspicata, la possibilità di addestrare questi sistemi incrementalmente[4], con uno sviluppo cognitivo-comportamentale articolato nel tempo (come per un essere umano dalla infanzia alla vita adulta), solo recentemente tali ambizioni stanno ritrovando una concretezza ed un crescente interesse da parte della comunità scientifica.

La recente attenzione sull’argomento è chiaramente riscontrabile in due recenti programmi di finanziamento alla ricerca sviluppati dall’agenzia di ricerca sulla difesa americana (DARPA)[5]: “Lifelong Learning Machines (L2M)” e “Shared-Experience Lifelong Learning (ShELL)”, dai numerosi bandi di Horizon Europe (il nuovo programma europeo di finanziamento settennale), corsi universitari, progetti editoriali, workshop e conferenze internazionali dove il tema risulta di rinnovato e centrale interesse.

Questo tipo di ricerca risulta particolarmente stimolante e al centro della sfida dello sviluppo dell’intelligenza artificiale non solo per la sua sostenibilità, ma anche perché ci interroga sulla vera natura dell’intelligenza, della memoria e dell’apprendimento, umano e computazionale.

Ad oggi, come un sistema di apprendimento biologico (ad esempio il cervello umano) riesca, computazionalmente, a bilanciare la necessità di ricordare e preservare le nostre memorie, conoscenze e capacità precedentemente apprese, ma, al contempo, offrire la possibilità di mutarle e acquisirne di nuove, rappresenta un’incognita centrale e fondante.

I nostri sistemi di apprendimento artificiali, sebbene lascamente ispirati ad architetture e processi neurobiologici (come le reti neurali), se esposti a situazioni e necessità cangianti, sono rapidamente in grado di adattarvisi, ma non di ricordare il passato e costruire incrementalmente nuove abilità e conoscenze sulla base delle esperienze pregresse. In sostanza, utilizzando una metafora neurologica, diremmo che soffrono di una forma di amnesia permanente (un po’ come nel film “Memento” di Cristopher Nolan, 2000) o, seguendo la nomenclatura tecnica, del fenomeno di “dimenticanza catastrofica” o “catastrophic forgetting”, frutto della limitatezza dei nostri algoritmi di apprendimento attuali.

L’apprendimento automatico continuo

La ricerca di frontiera su questo tema, invece, si concentra sulla progettazione e sviluppo di algoritmi efficaci, efficienti, scalabili ed in ultima analisi sostenibili di apprendimento automatico continuo (o “Continual Learning” all’anglosassone) per l’intelligenza Artificiale. Algoritmi che possano costruire incrementalmente le loro capacità sulla base delle esperienze pregresse, assorbendo conoscenza dai dati senza immagazzinarli (rispettando quindi la privacy degli utenti) ed essendo aggiornati rapidamente ed efficientemente (consumando quanto una lampadina); in ultima analisi migliorando robustezza ed autonomia di tali sistemi ovunque essi siano applicati, dal nostro frigorifero al nostro telefono cellulare, dalla nostra automobile ad un supercomputer.

Il ruolo dell’Italia: la piattaforma ContinualAI e il Pervasive AI Lab

L’Europa e soprattutto l’Italia si trovano (nuovamente) importanti protagonisti nell’ambito di questo importante cambiamento di paradigma nel contesto dell’intelligenza artificiale. In Italia trova la sede la più ampia organizzazione non-profit internazionale sul tema, ContinualAI[6], piattaforma didattica, di ricerca collaborativa e disseminazione che ha reso recentemente disponibile la più ampia libreria scientifica ad accesso aperto per l’archivio e sviluppo di algoritmi allo stato dell’arte di apprendimento automatico continuo (Avalanche[7]).

Sempre in Italia, il Pervasive AI Lab[8], un laboratorio frutto di un percorso condiviso tra l’Università di Pisa e Consiglio Nazionale delle Ricerche (CNR), presieduto dal Prof. Davide Bacciu (Professore Associato all’Università di Pisa e Vice-Presidente dell’Associazione Italiana di intelligenza artificiale) e Patrizio Dazzi (Ricercatore presso il CNR), costituisce un importante centro d’attrazione in Italia e nel mondo sulla tematica del Continual Learning, contando tra i suoi membri il co-fondatore e Presidente della stessa associazione ContinualAI.

I primi, sebbene iniziali, promettenti risultati della sua ricerca, costruiti negli anni mediante innumerevoli collaborazioni internazionali, attività non-profit, organizzazione eventi, progetti europei ed attività di consulenza, dimostrano come progettare algoritmi sostenibili di intelligenza artificiale non solo sia possibile senza inibire i nostri progressi in questo ambito, ma possa anche rendere tali sistemi più sicuri, autonomi, pervasivi e rispettosi dei valori a noi più cari di sostenibilità e progettazione umano-centrica.

- Il più grande (e grave) fallimento dell’intelligenza artificiale – Umanesimo Digitale ↑

- OpenAI’s massive GPT-3 model is impressive, but size isn’t everything | VentureBeat ↑

- L’Intelligenza Artificiale inquina: l’emissione di anidride carbonica è 5 volte più alta delle auto (fanpage.it) ↑

- I.—COMPUTING MACHINERY AND INTELLIGENCE | Mind | Oxford Academic (oup.com) ↑

- Defense Advanced Research Projects Agency (darpa.mil) ↑

- AI Weekly: Continual learning offers a path toward more humanlike AI | VentureBeat ↑

- Avalanche: an End-to-End Library for Continual Learning – Avalanche (continualai.org) ↑

- Pervasive AI Lab (unipi.it) ↑