Difendersi dai deepfake non è facile. La creazione di immagini e video manipolati realistici viene ormai resa possibile dall’Intelligenza artificiale, che fa leva su tecniche avanzate di deep learning basate su autoencoder (AE) o reti generative avversarie (GAN) per creare in modo automatico contenuti multimediali manipolati. Ma capire che si tratta di “falsi” sarà sempre più difficile. Vediamo perché.

Indice degli argomenti

Come riconoscere un video manipolato

In Figura 1 vengono mostrati alcuni esempi di deepfake che circolano su internet. In realtà, tutti questi video sono stati creati per gioco e coinvolgono attori e personaggi politici molto noti, in situazioni spesso improbabili, per cui è facile capire che si tratta di falsi. Inoltre, sul web è di solito possibile recuperare sia la versione originale che quella manipolata, cosa che rimuove ogni dubbio.

Se vengono meno queste condizioni, però, verificare l’integrità di un video può diventare molto più complicato. Questo scenario si verifica certamente nel caso di un attacco deliberato, in cui si acquisisce un filmato con un attore disponibile, il cui volto viene poi sostituito con quello della persona che si vuole attaccare. Inutile dire che in questo caso solo la versione manipolata del video sarà disponibile in rete.

Dato che la creazione di questi video richiede solo potenza di calcolo e un certo numero di immagini/video delle persone coinvolte, chiunque può essere minacciato da tale tecnologia, visto che molto spesso foto e video personali sono condivisi sui social network. Ovviamente, la diffusione di fake news supportate da contenuti multimediali rappresenta una minaccia seria in molti contesti. Basti pensare alla possibilità di condizionare elezioni politiche e più in generale di modificare l’opinione pubblica, ma anche attaccare la credibilità di persone comuni, utilizzando anche video porno.

La comunità scientifica si è attivata per sviluppare metodi affidabili che aiutino a rivelare in maniera automatica tali manipolazioni. In questo articolo descriveremo le tecniche più promettenti per rivelarli e metteremo in luce le principali sfide tecniche.

Figura 1: esempi di manipolazioni deepfake da YouTube. In alto i video manipolati e in basso gli originali. Nel caso di Obama e Trump, nei video originali ci sono due attori comici che li imitano.

Caccia aperta agli artefatti

I deepfake più diffusi coinvolgono la manipolazione di volti, anche perché il volto di una persona è la sua prima carta d’identità e trasmette messaggi non verbali di forte impatto. Alcune tecniche cercano quindi di evidenziare possibili artefatti visivi. Infatti, il processo di generazione non sempre riesce a riprodurre perfettamente tutti i dettagli di un volto, dettagli ai quali gli osservatori sono molto sensibili.

Per esempio, nei volti generati da una GAN può capitare che i due occhi non abbiano lo stesso colore, o si presentino altre forme di asimmetria, come la presenza di un orecchino da una sola parte o orecchie chiaramente diverse [1]. Alcuni tratti, poi, non sempre vengono riprodotti fedelmente, come i denti e a volte i capelli (Figura 2). Inoltre, dato che le tecniche per generare video falsi lavorano frame-by-frame, cioè elaborano un’immagine alla volta, si possono presentare perdite di coerenza lungo la direzione temporale. Ad esempio, negli esseri umani il battito delle ciglia [2] ha una specifica frequenza e durata che può mancare nei volti generati, così come le variazioni di tonalità indotte dalla dilatazione dei vasi dovuta al battito cardiaco [3, 4].

Altre incoerenze sono legate al fatto che i processi generativi realizzati mediante reti neurali non sempre sono in grado di introdurre vincoli che permettono di riprodurre perfettamente la realtà. Per esempio, manca un vincolo esplicito sulla posizione degli occhi, del naso e della bocca. Quindi, la distribuzione dei punti caratteristici di un volto, come i contorni degli occhi, del naso e della bocca si possono usare come feature discriminative [5]. Anche i colori possono presentare delle alterazioni, visto che mancano degli specifici vincoli sulla correlazione tra le bande. Le architetture GAN generano i colori nello spazio RGB (rosso-verde-blu), ma questo può portare degli artefatti nella tinta e saturazione dei colori [6].

È stato anche osservato che le espressioni facciali e i movimenti del capo sono fortemente correlate fra loro, in maniera diversa da soggetto a soggetto. Quindi, se una manipolazione non garantisce la coerenza fra questi due tipi di informazione, può essere facilmente scoperta [7]. Questo approccio però si presta solo alla protezione di un numero ristretto di “very important people”, dato che richiede la costruzione di un database alquanto complesso.

Figura 2: alcuni esempi di immagini generate sinteticamente da una GAN (rete generativa avversaria) che presentano alcuni artefatti e/o asimmetrie: diverso colore degli occhi, orecchie non perfettamente simmetriche, macchie bianche sui denti.

Se l’essenziale è invisibile agli occhi

Le tecniche ora descritte rappresentano strumenti preziosi per scoprire i deepfake. Nel realizzare un video falso, è facile che compaia qualche artefatto, che non siano rispettate certe simmetrie, che alcuni particolari rivelino incongruenze nascoste. Soprattutto, basta che una sola di queste verifiche di coerenza fallisca per far scattare il sospetto che il video non sia originale e innescare indagini più approfondite.

È del tutto illusorio però credere che questo possa segnare un punto decisivo nella lotta ai deepfake. Alla velocità con cui gli algoritmi di generazione migliorano, è probabile che nel giro di pochi anni i deepfake saranno praticamente perfetti, indistinguibili dai video veri anche per un osservatore attento. Esistono però altri approcci, più solidi e promettenti, che fanno riferimento non tanto alla Computer Vision quanto al Multimedia Forensics cioè lo studio forense dei contenuti multimediali.

Il concetto fondamentale è che ogni azione lascia una traccia. Anche la semplice acquisizione di un’immagine con una fotocamera digitale lascia una scia di tracce, invisibili agli occhi, ma molto difficili da cancellare. Le aberrazioni geometriche delle lenti, le imperfezioni del sensore, le molte elaborazioni numeriche di basso e alto livello interne alla camera, tutto lascia delle tracce che l’analista forense può portare alla luce e utilizzare.

È possibile caratterizzare ogni singolo modello di fotocamera e perfino ogni singolo device con una propria “impronta digitale” [8, 9] che in condizioni opportune permette di scoprire l’origine di una fotografia o di un video e di stabilire se un video è originale o generato da algoritmi di deep learning. Recentemente è stato dimostrato che anche le GAN lasciano nelle immagini che generano un marchio caratteristico, diverso per ogni architettura, che può essere utilizzato per scoprirne l’origine [10, 11].

Le “impronte” del deepfake

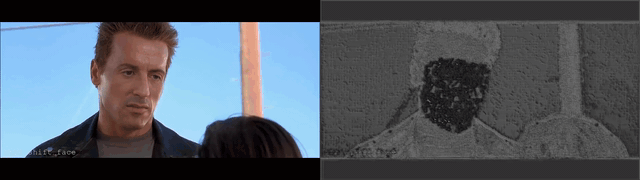

Naturalmente, scoprire e sfruttare queste tracce non è per niente facile, soprattutto quando immagini e sequenze video sono caricate sui social network dove vengono ridimensionate e compresse, operazioni che compromettono non solo la qualità visiva, ma anche, e soprattutto, i deboli segnali che costituiscono il cuore delle tecniche di multimedia forensics. In Figura 3 si mostra un frame di un video deepfake e la sua impronta digitale estratta mediante la tecnica proposta in [12], che può essere ulteriormente elaborata per tracciare la heatmap, una mappa colorata che ad ogni pixel associa un valore legato alla probabilità che sia stato manipolato.

Figura 2: in alto il frame di un video deepfake e la corrispondente fingerprint, in cui si nota una zona più scura sul volto. In basso l’estrazione delle heatmap in corrispondenza dei volti presenti nel video. L’analisi mostra chiaramente la manipolazione del volto di Arnold Schwarzenegger, che è stato modificato con quello di Stallone nel film Terminator (https://www.youtube.com/watch?v=Gz0QZP2RKWA).

Sistemi di AI vs sistemi di AI

Le tecniche più promettenti per combattere i deepfake usano esse stesse l’intelligenza artificiale. Questi metodi richiedono la disponibilità di grandi dataset di immagini o video, sia originali che manipolati, per poter “insegnare” alla rete neurale a distinguere il vero dal falso. Il primo dataset pubblicato con questo fine è FaceForensics++ [13], che contiene 4000 video con 4 diverse manipolazioni, che includono sia semplici modifiche dell’espressione che veri e propri face-swapping (sostituzione del volto con quello di un altro). In [13] si mostra come, grazie alla disponibilità di tanti esempi, sia possibile addestrare reti neurali profonde (deep networks) alla rivelazione di video manipolati, con prestazioni che superano largamente le capacità di discriminazione degli esseri umani.

Tuttavia, se la rete viene applicata a manipolazioni per le quali non era stata addestrata, allora le prestazioni calano drasticamente, e lo stesso accade su dati fortemente compressi (Figura 4). Per questo motivo la ricerca si sta focalizzando su modi per migliorare la robustezza e la capacità di generalizzazione di questi reti e permettere loro di adattarsi a nuovi tipi di manipolazioni. I filoni più promettenti sono quelli che addestrano la rete utilizzando solo la classe delle immagini/video originali e rivelano qualunque anomalia come possibile manipolazione, come le fingerprint di cui abbiamo parlato nel capitolo precedente [11, 12]. Un’altra possibilità è cercare di individuare un appropriato spazio di rappresentazione in cui sia possibile separare le caratteristiche comuni alle manipolazioni da quelle dei dati reali [14].

Recentemente il dataset FaceForensics++ è stato ampliato con ulteriori 3000 video messi a disposizione da Google [15], mentre Facebook ha lanciato un challenge su Kaggle [16, 17], in cui è stato creato un dataset di circa 100.000 video manipolati mediante tecniche di deep learning. La disponibilità di tutti questi dati è certamente di grande utilità per addestrare una rete in modo efficace e allo stesso tempo stimola la ricerca scientifica a migliorare sempre di più. Da notare che il dataset di Facebook non contiene solo video, ma anche audio manipolati. Infatti, tecniche recenti permettono di modificare anche solo poche parole di un discorso [18] oppure guidare i movimenti delle labbra a partire da un testo qualsiasi [19]. Esistono già delle tecniche che cercano di scoprire tali manipolazioni, focalizzandosi per esempio sulle incoerenze audio-visuali [20].

In conclusione, è evidente che il mondo della ricerca, grazie anche allo stimolo dei grandi player dell’Information Technology, sta producendo uno sforzo massiccio per la definizione di strumenti che possano proteggerci dalla manipolazione dell’informazione visuale. Tuttavia, vista la velocità del progresso tecnologico in questo campo, è difficile che tale protezione possa mai essere totale. Ci saranno sempre nuovi attacchi e nuovi sviluppi da inseguire. E’ quindi importante che cresca anche la consapevolezza degli utenti finali e la loro attenzione alla gestione dei dati personali, non più solo password, ma le loro stesse immagini e video.

Figura 4: risultati di localizzazione ottenuti mediante una rete profonda su un video reale (in alto) e su un video falso (in basso). I risultati mostrati mediante le heatmap sono molto buoni per video ad alta qualità (immagini al centro), mentre falsi allarmi cominciano ad apparire per video a più bassa qualità (immagini a destra).

Bibliografia

[1] F. Matern, C. Riess, and M. Stamminger, “Exploiting visual artifacts to expose deepfakes and face manipulations,” in IEEE WACV Workshop on Image and Video Forensics, 2019.

[2] Y. Li, M.-C. Chang, and S. Lyu, “In Ictu Oculi: Exposing AI created fake videos by detecting eye,” in IEEE Workshop on Information Forensics and Security, 2018.

[3] U. Ciftci, I. Demir, and L. Yin, “FakeCatcher: Detection of Synthetic Portrait Videos using Biological Signals,” arXiv preprint arXiv:1901.02212v2, 2019.

[4] S. Fernandes, S. Raj, E. Ortiz, I. Vintila, M. Salter, G. Urosevic, and S. Jha, “Predicting Heart Rate Variations of Deepfake Videos using Neural ODE,” in ICCV Workshops, 2019.

[5] X. Yang, Y. Li, H. Qi, and S. Lyu, “Exposing GAN-synthesized faces using landmark locations,” in ACM Workshop on Information Hiding and Multimedia Security, 2019.

[6] S. McCloskey and M. Albright, “Detecting GAN-Generated Imagery using Saturation Cues,” in IEEE International Conference on Image Processing.

[7] S. Agarwal and H. Farid, “Protecting world leaders against deep fakes,” in IEEE CVPR Workshops, 2018.

[8] M. Chen, J. Fridrich, J. Lukàs, and M. Goljan, “Imaging sensor noise as digital x-ray for revealing forgeries,” in International Workshop on Information Hiding, 2007.

[9] D. Cozzolino and L. Verdoliva, “Noiseprint: A CNN-based camera model fingerprint,” IEEE Trans. Inf. Forensics Security, 2020.

[10] F. Marra, D. Gragnaniello, L. Verdoliva, and G. Poggi, “Do GANs leave artificial fingerprints?” in 2nd IEEE International Workshop on Fake MultiMedia, 2019.

[11] N. Yu, L. Davis, and M. Fritz, “Attributing Fake Images to GANs: Learning and Analyzing GAN Fingerprints,” International Conference on Computer Vision, 2019.

[12] D. Cozzolino, G. Poggi, and L. Verdoliva, “Extracting camera-based fingerprints for video forensics,” in CVPR Workshops, 2019.

[13] A. Roessler, D. Cozzolino, L. Verdoliva, C. Riess, J. Thies, and M. Nießner, “FaceForensics++: Learning to detect manipulated facial images,” in International Conference on Computer Vision (ICCV), 2019.

[14] D. Cozzolino, J. Thies, A. R¨ossler, C. Riess, M. Nießner, and L. Verdoliva, “ForensicTransfer: Weakly-supervised domain adaptation for forgery detection,” arXiv preprint arXiv:1812.02510, 2018.

[15] N. Dufour, A. Gully, P. Karlsson, A.V. Vorbyov, T. Leung, J. Childs and C. Bregler, “Deepfakes Detection Dataset,” 2019.

[16] B. Dolhansky, R. Howes, B. Pflaum, N. Baram, and C. C. Ferrer, “The deepfake detection challenge (DFDC) preview dataset,” arXiv preprint arXiv:1910.08854v2, 2019.

[17] https://www.kaggle.com/c/deepfake-detection-challenge/

[18] Fried et al., “Text-based Editing of Talking-head Video,” ACM Transactions on Graphics, 2019.

[19] S. Suwajanakorn, S.M. Seitz, I. Kemelmacher-Shlizerman, “Synthesizing Obama: Learning Lip Sync from Audio,” ACM Transactions on Graphics, 2017.

[20] P. Korshunov, M. Halstead, D. Castan, M. Graciarena, M. McLaren, B. Burns, A. Lawson, and S. Marcel, “Tampered speaker inconsistency detection with phonetically aware audio-visual features,” in ICML Workshop on Detecting Audio-Visual Fakes, 2019.