La digital compliance è diventata un elemento imprescindibile per professionisti e aziende che operano nell’ecosistema digitale. Con l’evoluzione tecnologica e l’introduzione di normative come l’AI Act, comprendere e applicare correttamente i principi di conformità digitale rappresenta non solo un obbligo legale, ma anche un vantaggio competitivo strategico.

Indice degli argomenti

Cos’è la digital compliance: definizione e ambito di applicazione

Secondo le fonti accreditate europee e italiane, il termine “digital compliance” fa riferimento all’insieme delle attività, processi e strumenti finalizzati ad assicurare che prodotti, servizi, processi e documenti digitali rispettino le normative vigenti nel settore digitale. In particolare, comprende l’applicazione coordinata di regole in materia di protezione dei dati (GDPR), cybersecurity, mercati digitali (Digital Markets Act), servizi digitali (Digital Services Act), economia dei dati (Data Act) e intelligenza artificiale (AI Act).

La compliance digitale è pertanto strettamente legata all’idea di digital trust, ovvero la fiducia nella capacità di un’organizzazione di gestire correttamente i dati e le informazioni in modo sicuro, trasparente e conforme alla legge. Per uno studio professionale o un’azienda, la mancanza di questo “assetto deontologico” può comportare sanzioni, perdita di reputazione e invalidità dei procedimenti digitali. In sintesi, la digital compliance rappresenta, per le fonti istituzionali, il pilastro della legalità digitale in Europa e in Italia.

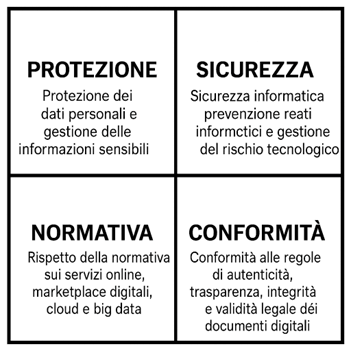

Le quattro aree della conformità digitale per professionisti e aziende

Per facilitare la comprensione delle attività da mettere in campo, possiamo provare a disegnare un quadrante, dove posizionare le diverse aree chiamate in causa per la gestione di un adeguato assetto di compliance digitale. Al primo posto inseriamo la Protezione dei Dati senza la quale non è possibile garantire le basi di conformità nella gestione di qualunque tipo di dato o informazione; al secondo posto citiamo la Sicurezza, dei sistemi informativi per la tutela da attacchi informatici o dai rischi connessi alla cybersicurezza; al terzo posto inseriamo la comprensione della Normativa, intesa non solo singolarmente ma anche intese nella correlazione reciproca tra leggi nazionali ed europee. Nell’ultima area collochiamo la Conformità intesa come rispetto dell’insieme delle normative.

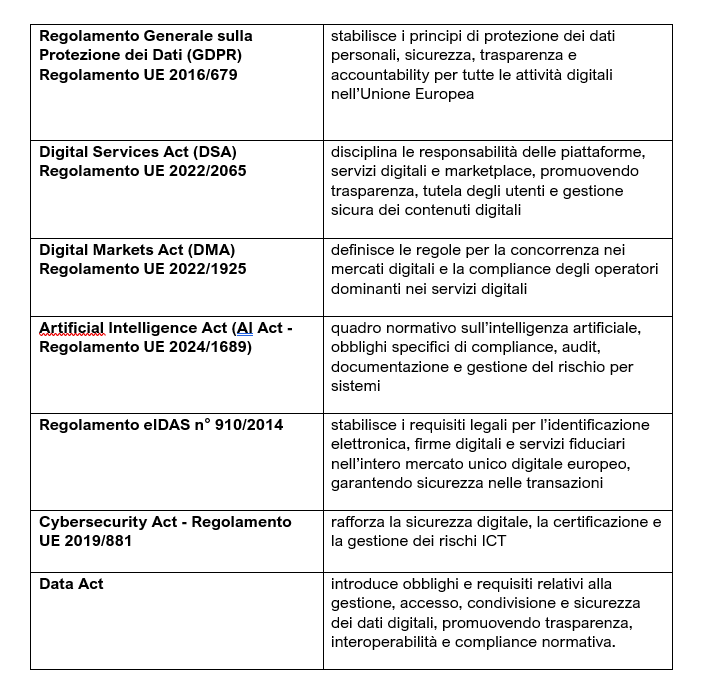

Il quadro normativo europeo: regolamenti e direttive per la compliance

Ma quali sono le normative europee ufficiali che regolano la Digital Compliance? Ogni regolamento, direttiva o standard europeo contribuisce a delineare la cornice normativa della digital compliance nel panorama europeo, garantendo processi digitali conformi e tutelando diritti fondamentali, sicurezza e trasparenza.

Nella tabella qui di seguito riportiamo l’elenco delle regolamentazioni europee da seguire.

Gli organismi UE che guidano l’applicazione della digital compliance

- Commissione Europea: Pubblica linee guida operative e interpretative sui principali regolamenti digitali, tra cui GDPR, Digital Services Act, AI Act, eIDAS e Data Act, e promuove codici di condotta, toolkit tecnici e raccomandazioni applicative rivolte agli Stati membri e agli operatori economici.

- EDPB (European Data Protection Board): Comitato europeo per la protezione dei dati; emette linee guida vincolanti sull’applicazione del GDPR e fornisce indicazioni specifiche per la compliance digitale soprattutto in merito ai dati personali, nuove tecnologie e gestione dei rischi.

- European Artificial Intelligence Office (EAIO): Coordinamento del monitoraggio e dell’enforcement dell’AI Act, con la pubblicazione di standard tecnici, procedure di audit e codici di conformità per sistemi IA.

- ENISA (Agenzia dell’Unione Europea per la Cybersecurity): Elabora linee guida in materia di sicurezza informatica, resilienza operativa digitale e gestione dei rischi ICT.

- Digital Services Coordinators: Autorità nazionali designate dagli Stati membri, coordinate dalla Commissione Europea, per applicare, monitorare e fornire linee guida, pareri e enforcement sui servizi digitali secondo il DSA.

- Gruppi di lavoro europei e reti tematiche: Ad esempio, i gruppi di esperti sull’economia dei dati, gli European Digital Innovation Hub e altre task force della UE che producono raccomandazioni, linee guida tecniche e best practice sulla digital compliance.

Questi organismi operano in sinergia per garantire chiarezza regolatoria e uniformità applicativa, fornendo supporti e strumenti alle aziende, ai professionisti e ai cittadini per una corretta conformità digitale nell’Unione Europea.

L’impatto dell’intelligenza artificiale sulla conformità digitale

L’adozione dell’intelligenza artificiale sta trasformando radicalmente il panorama della digital compliance. Dal 2025, con l’entrata in vigore della Legge 132/2025 in Italia e dell’AI Act europeo, aziende, professionisti e operatori pubblici devono affrontare una vera rivoluzione regolamentare, tecnologica e culturale.

Il Regolamento UE 2024/1689 (AI Act) – stabilisce obblighi stringenti per tutti i soggetti che sviluppano, implementano o utilizzano sistemi di intelligenza artificiale, includendo regole speciali per i modelli General Purpose AI (GPAI) e requisiti tecnici, di documentazione, valutazione del rischio, supervisione umana e trasparenza.

In Italia, la Legge 132/2025 integra queste regole, introducendo governance rafforzata, audit obbligatori, registri e notifiche agli enti di controllo, con sanzioni che arrivano fino al 7% del fatturato globale annuo. I dati sensibili e la sicurezza sono al centro delle prescrizioni, così come il rispetto del GDPR e la protezione dei diritti fondamentali.

Guida operativa: implementare la digital compliance negli studi professionali

Per implementare la Digital Compliance in uno studio professionale italiano, occorre seguire linee guida pratiche che bilancino innovazione, tutela e rispetto delle nuove norme su intelligenza artificiale. Questi passaggi operativi si fondano su regolamenti come la Legge 132/2025 e l’AI Act europeo, e sono indispensabili per commercialisti, notai e avvocati.

Audit e mappatura dei sistemi AI

- Identificare tutti gli strumenti di IA in uso (es. software per document review, contabilità predittiva, ricerca giuridica).

- Classificare i sistemi secondo il livello di rischio secondo le categorie dell’AI Act (alto, limitato, inaccettabile).

Policy interne e documentazione tecnica

- Redigere policy su privacy, antiriciclaggio e supervisione umana, integrate con le procedure operative.

- Documentare finalità, algoritmi e dataset utilizzati, per garantire auditabilità.

Formazione del team

- Formare soci, dipendenti e collaboratori su uso responsabile dell’IA e gestione dei dati.

- Aggiornare periodicamente la formazione in base alle evoluzioni normative.

Contrattualistica e trasparenza verso i clienti

- Inserire clausole specifiche sull’uso di IA nei contratti e nelle lettere d’incarico.

- Informare i clienti sul tipo di strumenti usati e sui loro diritti (ex art. 13 Legge 132/2025).

Procedure di data protection e controllo continuo

- Rafforzare le misure GDPR di sicurezza, minimizzazione e finalità dei dati.

- Monitorare e aggiornare periodicamente i sistemi AI per evitare rischi di non conformità.

Supervisione umana e governance dell’AI

- Garantire sempre un controllo umano sulle decisioni automatizzate.

- Nominare un referente interno per la governance dell’AI, analogo al DPO per il GDPR.

Queste linee operative, integrate con una cultura digitale, pongono lo studio nelle condizioni ottimali per cogliere le opportunità dell’AI, limitare i rischi e rispettare le responsabilità imposte dalla nuova Digital Compliance.

Strumenti AI per l’automazione della compliance e prospettive future

Le nuove frontiere della compliance sono legate all’adozione di strumenti automatizzati basati su AI, che consentono di:

- Audit digitali automatizzati e monitoraggio in tempo reale dei rischi normativi;

- Riduzione dei costi e dei tempi grazie a workflow e alert automatici;

- Gestione tracciata dei documenti e delle decisioni, in linea con i principi europei di trasparenza e accountability.

L’evoluzione della digital compliance richiede competenze multidisciplinari, processi adattabili e strumenti tecnologici innovativi. La normativa non si limita a richiedere conformità: impone anche trasparenza, auditabilità e accountability, segnalando che l’epoca del “black box” per la AI è ormai finita.

La digital compliance del futuro sarà “aumentata” dall’intelligenza artificiale, ma anche regolata da nuovi confini etici e giuridici.

Per i professionisti (dottori commercialisti), questo significa trasformare la compliance da obbligo a valore competitivo, integrando competenze legali, tecnologiche e organizzative in una gestione moderna dello studio professionale.

FAQ: compliance digitale

Che cos’è la compliance digitale e perché è importante per le aziende?

La compliance digitale rappresenta l’insieme delle attività, processi e strumenti finalizzati ad assicurare che prodotti, servizi, processi e documenti digitali rispettino le normative vigenti nel settore digitale. Comprende l’applicazione coordinata di regole in materia di protezione dei dati (GDPR), cybersecurity, mercati digitali (Digital Markets Act), servizi digitali (Digital Services Act), economia dei dati (Data Act) e intelligenza artificiale (AI Act). È strettamente legata al concetto di digital trust, ovvero la fiducia nella capacità di un’organizzazione di gestire correttamente i dati e le informazioni in modo sicuro, trasparente e conforme alla legge. Per un’azienda o uno studio professionale, la mancanza di questo “assetto deontologico” può comportare sanzioni, perdita di reputazione e invalidità dei procedimenti digitali. La compliance digitale è diventata un elemento imprescindibile non solo come obbligo legale, ma anche come vantaggio competitivo strategico, rappresentando il pilastro della legalità digitale in Europa e in Italia.

Quali sono le principali normative europee che regolano la compliance digitale?

Le principali normative europee che regolano la compliance digitale includono il GDPR (Regolamento Generale sulla Protezione dei Dati), che stabilisce le regole per il trattamento dei dati personali; la Direttiva NIS2, che impone misure rigorose per proteggere le reti e i sistemi IT; il DORA (Digital Operational Resilience Act), che richiede resilienza operativa nel settore finanziario; il Digital Markets Act (DMA) e il Digital Services Act (DSA), che regolamentano rispettivamente i mercati e i servizi digitali; il Data Act, che disciplina l’economia dei dati; e l’AI Act (Regolamento UE 2024/1689), che stabilisce obblighi per lo sviluppo, l’implementazione e l’utilizzo di sistemi di intelligenza artificiale. Queste normative contribuiscono a delineare la cornice normativa della digital compliance nel panorama europeo, garantendo processi digitali conformi e tutelando diritti fondamentali, sicurezza e trasparenza. In Italia, la Legge 132/2025 integra queste regole europee, introducendo governance rafforzata, audit obbligatori, registri e notifiche agli enti di controllo, con sanzioni che possono arrivare fino al 7% del fatturato globale annuo.

Come implementare un sistema di compliance digitale efficace in uno studio professionale?

Per implementare un sistema di compliance digitale efficace in uno studio professionale, è necessario seguire un approccio strutturato che bilanci innovazione, tutela e rispetto delle normative. Il processo dovrebbe iniziare con una mappatura completa dei processi digitali dello studio, identificando quali dati vengono trattati e con quali finalità. È fondamentale designare un responsabile della compliance digitale che coordini le attività e mantenga aggiornate le politiche interne. Lo studio deve implementare misure di sicurezza adeguate, come sistemi di autenticazione a più fattori e crittografia, e condurre regolarmente valutazioni d’impatto sulla protezione dei dati. È essenziale anche formare continuamente il personale sui rischi digitali e sulle procedure di conformità, documentare tutte le attività di compliance per dimostrare l’accountability, e stabilire procedure chiare per la gestione dei data breach. Infine, è importante adottare un approccio proattivo con audit periodici e aggiornamenti delle procedure in base all’evoluzione normativa. Queste linee operative, integrate con una cultura digitale consapevole, pongono lo studio nelle condizioni ottimali per cogliere le opportunità tecnologiche, limitare i rischi e rispettare le responsabilità imposte dalla nuova Digital Compliance.

Quali sono i vantaggi di un sistema GRC (Governance, Risk & Compliance) per la gestione della compliance digitale?

Un sistema di GRC (Governance, Risk & Compliance) offre numerosi vantaggi per la gestione della compliance digitale. Innanzitutto, permette di ottimizzare i processi di adeguamento normativo sfruttando i punti in comune tra diverse leggi e regolamenti, nonostante la specificità degli ambiti di applicazione. Un sistema GRC facilita la gestione integrata della sicurezza delle informazioni, della responsabilità e governance, del risk management, della continuità operativa e resilienza, della qualità e miglioramento continuo, e degli obblighi di notifica degli incidenti. Consente inoltre di condurre valutazioni del rischio strutturate, implementare controlli appropriati, monitorare continuamente la conformità, documentare le attività di compliance in modo centralizzato e adattarsi rapidamente ai cambiamenti normativi. Le aziende che adottano un sistema GRC possono beneficiare di una maggiore efficienza operativa, riduzione dei costi legati alla non conformità, miglioramento della gestione del rischio, e rafforzamento della reputazione aziendale. Questo approccio è particolarmente importante per le aziende che operano in settori altamente regolamentati o che fanno parte della supply chain di imprese soggette a normative stringenti sulla cybersecurity e la protezione dei dati.

Come la compliance digitale può creare valore per un’azienda?

La compliance digitale può trasformarsi da mero adempimento normativo a vero e proprio creatore di valore aziendale. Un esempio concreto è il caso di NEXT TRE, società di progettazione e servizi nel settore dell’automazione industriale, che ha implementato un progetto di automazione dei processi di compliance con effetti dirompenti. Questa trasformazione digitale ha portato alla modernizzazione dei processi e del business attraverso tecnologie avanzate, valorizzando la gestione del rischio e migliorando la conformità alle normative. Il progetto ha permesso di cogliere nuove opportunità di gestione delle attività, individuare modelli di business vantaggiosi e consolidare la reputazione aziendale. La piattaforma software implementata ha ottimizzato la gestione dei rischi, la tracciabilità delle attività, la documentazione e il monitoraggio della conformità, riducendo il rischio di sanzioni. I benefici includono maggiore efficienza operativa, riduzione dei costi, miglioramento della qualità dei servizi, rafforzamento della reputazione, aumento della trasparenza e della responsabilità, e una migliore gestione delle risorse umane. La compliance digitale diventa così un prerequisito di competitività, specialmente per gli stakeholder, e un elemento fondamentale per la creazione di valore a lungo termine.

Quali sono le sfide principali nell’implementazione della compliance digitale?

Le sfide principali nell’implementazione della compliance digitale includono il superamento dell’approccio meramente formale e documentale. Esiste il rischio di cadere nella “Compliance of illusion”, un sistema di regole apparentemente perfette ma progettate per un mondo che non esiste, dove ci si concentra sulla produzione di documenti piuttosto che sulla sicurezza effettiva. Le organizzazioni spesso si trovano sommerse da piattaforme di compliance, checklist e fogli di calcolo, mentre nel mondo reale il livello di sicurezza può essere molto meno rassicurante. Un’altra sfida significativa riguarda la gestione della supply chain dei servizi IT, dove la complessità tecnica crescente si scontra con strumenti di controllo standardizzati e astratti. Le aziende tendono a compilare checklist generiche identiche per tutti i fornitori, senza distinguere realmente i livelli di criticità, e utilizzano piattaforme informatiche come semplici archivi di certificazioni senza verificarne il significato pratico. Inoltre, c’è una mancanza di formazione effettiva e consapevolezza reale delle persone coinvolte, con eccessiva fiducia nelle autodichiarazioni dei fornitori. Per superare queste sfide, è necessario trasformare il rapporto con la supply chain da un semplice scambio meccanico di moduli standardizzati a un confronto reale e sostanziale, concentrare le risorse su controlli mirati ma efficaci, e ridefinire gli obiettivi della funzione compliance verso una gestione effettiva del rischio piuttosto che una mera dimostrazione formale di conformità.

Come l’intelligenza artificiale sta trasformando la compliance digitale?

L’intelligenza artificiale sta trasformando radicalmente il panorama della compliance digitale. Con l’entrata in vigore della Legge 132/2025 in Italia e dell’AI Act europeo (Regolamento UE 2024/1689), aziende, professionisti e operatori pubblici devono affrontare una vera rivoluzione regolamentare, tecnologica e culturale. Questi regolamenti stabiliscono obblighi stringenti per tutti i soggetti che sviluppano, implementano o utilizzano sistemi di intelligenza artificiale, con regole speciali per i modelli General Purpose AI (GPAI) e requisiti tecnici, di documentazione, valutazione del rischio, supervisione umana e trasparenza. L’AI sta anche rivoluzionando gli strumenti di compliance stessi, consentendo l’automazione del monitoraggio normativo, l’analisi predittiva dei rischi, la verifica automatica della conformità, la gestione intelligente dei documenti e la personalizzazione delle politiche di compliance. Questo porta a una compliance “aumentata” dall’intelligenza artificiale, ma anche regolata da nuovi confini etici e giuridici. L’evoluzione della digital compliance richiede competenze multidisciplinari, processi adattabili e strumenti tecnologici innovativi, segnalando che l’epoca del “black box” per l’AI è ormai finita. Per i professionisti, questo significa trasformare la compliance da obbligo a valore competitivo, integrando competenze legali, tecnologiche e organizzative in una gestione moderna dello studio professionale.

Qual è l’approccio basato sul rischio nelle normative UE sulla compliance digitale?

L’approccio basato sul rischio nelle normative UE sulla compliance digitale si fonda sull’istituzione di un quadro normativo dove obblighi e doveri vengono graduati e adattati al concreto rischio connesso alle attività. Questo supera la logica binaria dell’adempimento per realizzare una forma di “compliance 2.0”, dove gli obblighi sono personalizzati per i destinatari della regolazione. A partire dalla Strategia per il mercato unico digitale in Europa, le istituzioni dell’Unione hanno fatto un ricorso crescente allo strumento del rischio per incentivare una maggiore accountability da parte degli attori coinvolti. Nel GDPR, questo approccio è declinato attraverso il principio di accountability (art. 5(2)), dove titolare e responsabile del trattamento devono predisporre misure tecnico-organizzative necessarie e operare una valutazione di impatto delle loro attività. Nel Digital Services Act (DSA), si individuano quattro regimi giuridici differenti basati sulla tipologia e dimensione dei fornitori di servizi di intermediazione, con un passaggio parziale da una logica bottom-up a una top-down. Nell’AI Act, il passaggio a un modello top-down è più marcato, con quattro categorie di rischio per i sistemi di intelligenza artificiale (rischio inaccettabile, alto rischio, rischio limitato, rischio minimo). Nonostante le apparenti incoerenze tra le diverse forme di risk-based approach, tutte mirano a realizzare un bilanciamento tra gli interessi economici all’innovazione e gli interessi alla tutela dei valori democratici e dei diritti fondamentali, con la proporzionalità come principio unificante delle politiche digitali dell’UE.

Come gestire la compliance digitale in relazione all’identità digitale?

La gestione della compliance digitale in relazione all’identità digitale richiede un approccio integrato che consideri l’intero ciclo di vita dei servizi digitali, dalla verifica dell’identità al rilascio della firma elettronica qualificata. Per percepire i vantaggi di una corretta gestione dell’identità digitale è necessario mappare i vari casi d’uso, comprendere le finalità dell’identificazione e considerare il target di riferimento, inclusa la familiarità degli utenti con gli strumenti digitali. La tecnologia offre diverse soluzioni, dal riconoscimento autonomo con AI alla verifica dell’identità tramite SPID o CIE, fino al futuro Eudi wallet europeo che conterrà l’identità digitale delle persone, documenti e varie credenziali. L’integrazione tra attività documentale e identità digitale semplifica i workflow, rendendo più facile compilare e sottoscrivere documenti, inviare copie di cortesia e immetterli nei sistemi di conservazione. La sicurezza deve essere garantita senza rendere i processi complessi per l’utente, sfruttando tecnologie come l’intelligenza artificiale per monitoraggio e verifiche puntuali. È fondamentale anche rispettare il GDPR, minimizzando le informazioni richieste e rispettando le norme sulla data retention. Le soluzioni integrate per la gestione dell’identità digitale, come piattaforme che abilitano diverse modalità di identificazione e si integrano con sistemi di firma elettronica, offrono flessibilità e compliance a tutte le normative di settore, garantendo sicurezza, protezione dei dati e interoperabilità con i futuri standard europei.

Come passare da una compliance formale a una sostanziale nella gestione digitale?

Per passare da una compliance formale a una sostanziale nella gestione digitale, è necessario un cambio di paradigma che vada oltre la mera produzione di documenti e checklist. Bisogna trasformare il rapporto con la supply chain da un semplice scambio meccanico di moduli standardizzati a un confronto reale e sostanziale, verificando effettivamente le capacità tecniche dei fornitori attraverso domande specifiche e contestualizzate, e richiedendo dimostrazioni pratiche delle misure di sicurezza dichiarate. È importante riconoscere che non si può controllare tutto, ma si possono fare controlli mirati e sostanziali, concentrando le risorse su verifiche tecnicamente competenti che permettano di capire se la narrazione del fornitore regge alla prova dei fatti. La cultura interna dell’organizzazione deve evolvere dalla domanda “Siamo compliant?” a interrogativi più profondi come “Quali sono i nostri rischi più significativi?”, “Quali compromessi stiamo accettando?”, “Chi ha l’autorità di decidere quali rischi accettare?”. La compliance autentica non elimina il rischio, ma lo rende visibile, discusso e gestibile in modo consapevole. Questo richiede coraggio: per i professionisti della compliance, significa ripensare il proprio ruolo da produttori di documentazione ad architetti di sistemi organizzativi; per il management, significa assumere la conformità come elemento strategico. L’obiettivo è passare da una compliance illusoria a una compliance matura che riconosca i limiti, accetti l’imperfezione e lavori seriamente sulla gestione dell’incertezza.

Qual è il rapporto tra compliance digitale ed etica nell’uso dell’intelligenza artificiale?

Il rapporto tra compliance digitale ed etica nell’uso dell’intelligenza artificiale è complesso e multidimensionale. La compliance non riguarda più solo il rispetto formale delle regole, ma implica anche la capacità di dimostrare, attraverso procedure e documenti, di averle rispettate. Con l’IA questa sfida si intensifica a causa dell’opacità algoritmica, della responsabilità distribuita tra molteplici attori e del trade-off tra spiegabilità e accuratezza dei modelli. L’AI Act europeo (Regolamento UE 2024/1689) tenta di mettere ordine con requisiti dettagliati per i sistemi ad alto rischio, ma emerge una tensione tra conformità formale ed etica sostanziale. La vera sfida è trasformare la compliance da mera legalità (conformità eteronoma) a genuina moralità (autonomia etica), progettando sistemi AI non solo “by law” ma “by design”. Questo richiede di passare dalla compliance all’integrity, coltivando nelle organizzazioni una cultura in cui ogni sviluppatore si sente personalmente responsabile delle implicazioni etiche del proprio lavoro. L’approccio etico deve essere concepito come pratica riflessiva, con spazi deliberativi dove le implicazioni dei sistemi AI possono essere discusse apertamente, valorizzando voci diverse e trattando il dissenso come risorsa. La compliance ripensata come capability si concentra non solo sul rispetto formale delle regole, ma sull’impatto sostanziale dei sistemi AI sulla vita delle persone e sull’espansione delle loro libertà effettive. In definitiva, la compliance autentica nell’era dell’IA richiede di andare oltre la documentazione formale verso una responsabilità etica più profonda e impegnativa.