La Commissione Europea ha presentato le linee strategiche per i prossimi anni per assicurare un ruolo all’Unione Europea nell’ambito delle tecnologie digitali. Le linee di azione, contenute nella comunicazione COM(2020) 67 final, sono accompagnate da tre documenti in cui si approfondiscono i vari temi considerati prioritari per la Commissione: un white paper sull’intelligenza artificiale, un report sulle implicazioni di sicurezza e responsabilità dell’intelligenza artificiale, IoT e robotica, e una comunicazione sulla strategia riferita ai dati.

Indice degli argomenti

La strategia della Commissione ue sull’intelligenza artificiale

Per comprendere la strategia complessiva, quindi, è necessario esaminare il contenuto di tutti i quattro documenti sopra citati, riuscendo così a ricostruire il quadro unitario degli aspetti che la Commissione intende affrontare sotto i vari punti di vista: politico, economico, giuridico e tecnico. Ciò che a noi interessa in questo scritto, però, è lo specifico aspetto collegato allo sviluppo dell’intelligenza artificiale. Innanzitutto, appare importante sottolineare il motivo che ha condotto la Commissione Europea, tra i vari temi tecnologici “posti sul tavolo” (5G, piattaforme, blockchain, quantum computing, cloud, etc.), a dedicare una particolare attenzione proprio al tema dell’intelligenza artificiale, concentrando su di esso due dei tre documenti che accompagnano la strategia.

Su tale tecnologia l’UE sta da tempo concentrando la propria attenzione, sollecitando la cooperazione tra i Paesi Membri e cercando di assumere una posizione di rilievo all’interno del panorama mondiale, soprattutto differenziando il proprio approccio rispetto a quello degli Stati Uniti e della Cina, attraverso una maggiore attenzione ai profili etici di questa tecnologia ed alla tutela, nel solco della tradizione europea, dei diritti e delle libertà fondamentali dell’uomo.

D’altra parte l’intelligenza artificiale è una tecnologia che potremmo definire “trasversale”: il white paper sottolinea che essa può portare benefici ai cittadini (nella medicina, nei trasporti ed in migliori servizi pubblici), alle imprese (con sviluppo di nuovi prodotti e servizi in settori in cui l’Europa è particolarmente forte) e nei servizi pubblici (per i trasporti, la formazione, l’energia e la gestione dei rifiuti).

Proprio per tali motivi la Commissione intende scongiurare l’adozione di iniziative unilaterali da parte degli Stati membri in quanto potrebbero mettere a rischio la certezza giuridica e la fiducia dei cittadini.

Le linee politiche di azione sull’AI

Dal punto di vista politico il white paper riporta sette azioni da intraprendere all’interno dell’Unione Europea, di cui sei espressamente indicate e dettagliate nel documento, mentre la settima, relativa all’accesso ai dati ed alle infrastrutture di calcolo, è maggiormente dettagliata nella comunicazione sull’apposita strategia.

La prima linea d’azione è riferita alla cooperazione con gli Stati membri. In particolare, la Commissione provvederà ad implementare il piano d’azione coordinato sull’intelligenza artificiale già adottato nel mese di aprile 2018, con l’obiettivo di attrarre investimenti (per 20 miliardi di euro) sulle tecnologie di intelligenza artificiale.

In secondo luogo vi saranno azioni per facilitare la creazione di centri di eccellenza e sperimentazione sull’intelligenza artificiale (attraverso investimenti privati e pubblici) al fine di incentivare la ricerca e sviluppo e di attrarre i ricercatori.

La terza linea di azione riguarda il “Digital Education Plan” con cui si cercherà di aumentare il grado di conoscenza dell’intelligenza artificiale a tutti i livelli di istruzione, anche trasformando le linee guida etiche in una risorsa per la formazione di tutti coloro che sviluppano su sistemi di intelligenza artificiale. Sempre nell’ambito delle competenze è la volontà di rinforzare il network delle università per attrarre i migliori professori e scienziati ed offrire percorsi di alta formazione che siano in linea con quelli erogati nei paesi leader del mondo.

Il quarto intervento si focalizza sulle piccole e medie imprese, in quanto prevede che vi sia in almeno ogni Stato membro un digital innovation hub con forte specializzazione sull’intelligenza artificiale. Inoltre, nel primo trimestre del 2020 è prevista la messa a disposizione tramite l’European Investment Fund di 100 milioni di euro per investimenti in equity su sviluppi innovativi dell’intelligenza artificiale.

La quinta iniziativa riguarda l’istituzione di una nuova partnership nell’ambito di Horizon Europe al fine di combinare gli sforzi, assicurare il coordinamento della ricerca ed innovazione sull’intelligenza artificiale, collaborare con altre partnership pubblico-private e i centri di eccellenza e Digital Innovation Hub oggetto delle altre linee di azione.

Come ulteriore linea di intervento, la sesta si concentra sulla promozione dell’adozione dell’intelligenza artificiale nel settore pubblico, ed in particolare nei settori della sanità, agricoltura e servizi pubblici. Il progetto è quello di preparare uno specifico “programma di adozione dell’AI” per supportare il procurement pubblico di soluzioni di intelligenza artificiale ed i processi di procurement stessi.

La settima linea di azione è focalizzata sull’accesso ai dati ed alle infrastrutture. Essa, quindi, è descritta nel dettaglio nell’ulteriore documento presentato dalla Commissione Europea relativo alla Strategia Europea sui dati. Tale documento descrive le iniziative che si intendono adottare per creare un “mercato unico dei dati” in cui le informazioni possano circolare al fine di essere utilizzate all’interno di tutta l’Unione Europea. Per far ciò si ritiene di dover fissare delle regole per il riuso dei dati, di investire sui nuovi standard, strumenti ed infrastrutture, di rafforzare le capacità del cloud europeo, di creare degli spazi europei di dati in cui condividere le informazioni nei settori chiavi e di fornire agli utenti strumenti e diritti per il controllo dei loro dati.

Il framework di regolazione dell’intelligenza artificiale: un ecosistema di fiducia

Partendo dai lavori svolti dal Gruppo di alti esperti già costituito dalla Commissione Europea, che avevano pubblicato le Linee Guida sull’intelligenza artificiale “affidabile” nell’aprile 2019, la Commissione intende proporre un framework regolamentare al fine di prevenire i rischi, materiali ed immateriali, che l’implementazione dei sistemi intelligenti potrebbero porre in assenza di norme di prevenzione, soprattutto con riferimento ai diritti fondamentali delle persone, inclusi la protezione dei dati personali e la non discriminazione delle stesse.

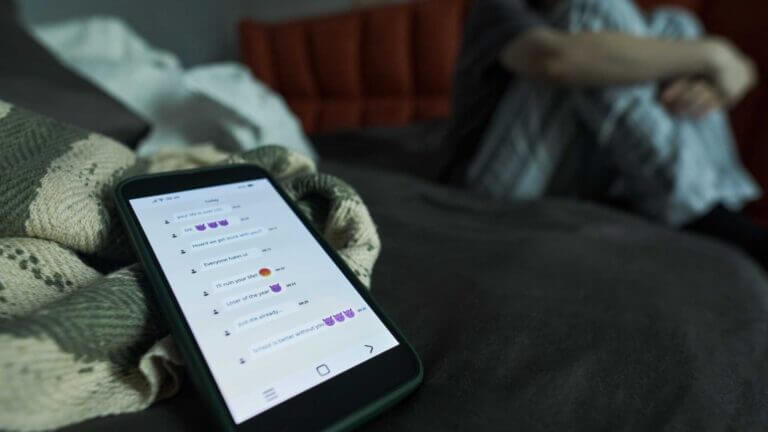

Il white paper, infatti, sottolinea come l’intelligenza artificiale potrebbe essere utilizzata anche per scopi non in linea con la protezione dei diritti delle persone, come i processi di de-anonimizzazione dei dati, di profilazione comportamentale, di sorveglianza di massa, andando ad incidere sulla libertà di manifestazione del pensiero, di riunione, sulla dignità umana, sull’uguaglianza e non discriminazione, sul diritto ad un giusto processo e sui diritti dei consumatori.

L’utilizzo di tali sistemi, infatti, aumenta le capacità lesive in quanto idonei ad essere applicati anche su larga scala.

A tali preoccupazioni si aggiungono quelle legate alla sicurezza dei sistemi stessi, soprattutto se incorporati in prodotti fisici (si pensi alle auto a guida autonoma, ai droni per le consegne, ai robot per assistenza domiciliare). In tali casi il documento sottolinea che è altamente probabile che si verifichino dei danni materiali alle persone, con conseguente necessità, quindi, di istituire chiari meccanismi per garantire livelli adeguati di sicurezza.

La Commissione Europea individua alcune lacune dell’attuale legislazione che andrebbero colmate per renderla idonea ad affrontare tali rischi:

- Il rafforzamento e l’effettiva applicazione delle normative nazionali. Sotto tale punto di vista l’opacità dei sistemi di intelligenza artificiale (intesa quale la difficoltà di comprendere come essi agiscono) rende difficile individuare eventuali violazioni delle normative esistenti con necessità, quindi, di adattare le stesse al mutato panorama tecnologico;

- la specificità degli scopi della disciplina attuale. La disciplina sulla responsabilità da prodotto e la sicurezza degli stessi in Europa è incentrata proprio sul concetto di prodotto, mentre i sistemi di intelligenza artificiale sono frequentemente utilizzati per erogare servizi, che, pertanto, non rientrano in tale ambito;

- L’evoluzione delle funzionalità dei sistemi di intelligenza artificiale. Gran parte dell’attuale legislazione è focalizzata sulla sicurezza del prodotto al momento dell’immissione sul mercato. I sistemi di intelligenza artificiale, ed i prodotti che li incorporano, però, evolvono con il tempo e, quindi possono presentare dei rischi in momenti successivi;

- Incertezza sull’allocazione della responsabilità tra i diversi operatori economici della filiera. La responsabilità da prodotto è incentrata sulla figura del produttore, ma possono presentarsi situazioni in cui il sistema di intelligenza artificiale sia realizzato ed inserito nel prodotto da un soggetto terzo dal produttore del bene;

- Evoluzione del concetto di sicurezza. I sistemi di intelligenza artificiale possono presentare rischi per la sicurezza che in realtà non rientrano nell’attuale disciplina normativa. Problemi di cybersecurity, rischi sulla sicurezza personale, rischi da perdita di connessione.

Al fine di fornire un approccio normativo unitario in tutta l’Unione, il white paper della Commissione individua e propone un approccio basato sul rischio al fine di evitare un eccessivo irrigidimento delle regole che, nel settore delle nuove tecnologie, potrebbe avere l’effetto indesiderato di essere un impedimento all’innovazione.

E’ bene sottolineare che oramai tale approccio è ampiamente utilizzato dalla legislazione europea in diversi settori, proprio per cercare di non creare eccessivi “lacci e lacciuoli” agli operatori economici, ma andando comunque a disciplinare quelle ipotesi in cui si ravvisano rischi elevati per i diritti e le libertà dei consumatori e cittadini.

Ed è proprio sul concetto di “rischio elevato” che si concentra la Commissione Europea, prendendo in considerazione due specifici parametri:

- Il settore di applicazione del sistema di intelligenza artificiale, la cui lista dovrebbe essere espressamente indicata nel nuovo sistema regolamentare proposto;

- L’utilizzo del sistema di intelligenza artificiale, considerato l’impatto che esso può avere nei confronti degli utilizzatori.

La gravità del rischio deve essere considerata tenendo conto entrambe detti criteri, in quanto possono esservi utilizzi in settori particolari (ad esempio la sanità) che non comportano rischi elevati.

Riconosciuto che il sistema può presentare un rischio elevato per i diritti e le libertà delle persone, il documento fissa alcuni prerequisiti che la regolazione futura dovrà prevedere per tali sistemi, anche attraverso l’applicazione di specifici standard.

Il framework normativo futuro dovrà, pertanto, imporre le seguenti caratteristiche ai sistemi di intelligenza artificiale che presentano un rischio elevato di incidere sui diritti e le libertà degli utilizzatori:

- qualità dei dataset utilizzati per il training dei sistemi. I dati utilizzati per addestrare l’intelligenza artificiale devono essere tali da assicurare la sicurezza dei prodotti e dei servizi resi tramite tali sistemi, non consentire discriminazioni conseguenti alla non estensione delle tipologie di dati ed, infine, rispettosi del principio di privacy by design;

- mantenimento dei dati, ossia la necessità che venga conservata, nelle applicazioni di AI che presentano un rischio elevato, una registrazione dei dati utilizzati per il training ed il test dei sistemi, che venga documentata la fase di programmazione del software e la metodologia di training e test adottata, in modo da consentire un controllo ex post del sistema stesso;

- trasparenza intesa quale obbligo di fornire adeguate informazioni sulle capacità e limitazioni del sistema, sugli scopi per cui è stato realizzato, i risultati attesi dal suo utilizzo e le condizioni in base alle quali questi sono prodotti. Trasparenza è intesa anche come riconoscibilità del sistema di intelligenza artificiale, nel senso che un cittadino dovrebbe essere messo sempre a conoscenza del fatto che sta interagendo con un sistema di intelligenza artificiale, evitando così condotte decettive, atte a trarre in inganno i consumatori;

- robustezza ed accuratezza, in fase di sviluppo del sistema in modo da prevenire ed eliminare i rischi derivanti dal suo utilizzo;

- intervento umano. Le applicazioni di intelligenza artificiale che presentano un rischio elevato dovranno prevedere la possibilità dell’intervento di un essere umano, in linea con quanto già stabilito dall’art. 22 GDPR. L’intervento potrà essere contemplato al fine di rendere effettiva una decisione adottata da un sistema di intelligenza artificiale, oppure come controllo successivo della decisione stesso, oppure quale monitoraggio dell’attività del sistema con possibilità di interromperne il funzionamento o, infine, in fase di progettazione, imponendo vincoli operativi al sistema in presenza di determinate condizioni;

- requisiti specifici per l’identificazione biometrica remota. Il white paper affronta anche il tema della sorveglianza di massa, tramite i sistemi di riconoscimento facciale, nell’ambito della più ampia categoria dei sistemi di identificazione biometrica. Il tema ha un’importanza particolare, vista la progressiva diffusione di tale tecnologia in Europa, e la Commissione Europea anticipa in questo documento la volontà di aprire un ampio dibattitto al fine di individuare le specifiche circostanze che giustificano l’utilizzo di tali sistemi e le possibili garanzie da adottare. Secondo la Commissione l’uso di tecnologie biometriche di identificazione a distanza potrebbe essere giustificato solo in limitati casi, soprattutto in presenza di un interesse pubblico, e comunque nel rispetto del principio di proporzionalità.

I requisiti indicati nel nuovo framework normativo dovrebbero essere verificati tramite una valutazione di conformità. La conformità potrebbe essere valutata con dei test, delle ispezioni o dei meccanismi di certificazione.

Gli obblighi imposti dalla nuova regolamentazione saranno distribuiti tra i vari soggetti della filiera dei sistemi di intelligenza artificiale, e dovranno applicarsi per i servizi resi in Unione Europea indipendente dalla sede di stabilimento del produttore e/o fornitore del servizio/prodotto.

Infine, è prevista la possibilità di istituire degli schemi volontari di certificazione per i sistemi che non presentano un rischio elevato.

Considerazioni finali

Le linee d’azione sul futuro digitale dell’Unione Europea indicate dalla Commissione vogliono sottolineare la sempre maggiore importanza che in questi anni hanno assunto le nuove tecnologie nel contesto dei mercati internazionali. Rispetto l’Agenda Europea 2020, che si concentrava prevalentemente su azioni tese ad uniformare la disciplina dei servizi online, la Commissione si concentra su una specifica tecnologia sottolineando l’importanza che essa sempre più assumerà nell’erogazione dei servizi ai consumatori ed ai cittadini.

Il white paper chiarisce che la futura legislazione sarà rivolta solo a specifici sistemi di intelligenza artificiale, il cui utilizzo può presentare un rischio elevato per le persone. Ciò sembra escludere dalla portata della normativa quelle applicazioni dell’intelligenza artificiale che oggi sono ampiamente utilizzate sia nei servizi online, come la profilazione degli utenti a fini marketing, sia in altri contesti come, ad esempio, gli algoritmi utilizzati per il trading online dai grandi fondi speculativi o gli assistenti vocali oramai ampiamente diffuse nelle case dei consumatori.

Anche le indicazioni contenute nel documento circa i sistemi di sorveglianza basate sul riconoscimento facciale non sembrano in realtà molto convincenti. Da più parti ci si aspettava una moratoria, in attesa della definizione di regole specifiche a tutela delle persone soggette a tali sistemi di controllo, mentre il white paper si limita a porre l’accento sulla necessità di aprire un confronto su tale tema, oltretutto giustificando in via anticipata l’utilizzo dei sistemi di sorveglianza sulla base di un generale interesse pubblico.

Il documento, come da tradizione, è stato posto in consultazione pubblica dalla Commissione e sicuramente esso offre lo spunto per riflettere in maniera approfondita sulle politiche legislative da adottare per disciplinare una tecnologia che ha un enorme potenziale di impatto sulla vita di tutti i cittadini. L’Europa conferma così di voler essere uno dei principali attori del settore, associando alla ricerca e sviluppo sulle nuove tecnologie delle regole per renderle adeguate alla tradizione giuridica del continente, regole che potranno essere di esempio agli altri Paesi che stanno investendo nel progresso dell’intelligenza artificiale.