Il decreto italiano sul Gdpr (101/2018) ha portato a 14 anni l’età minima per esprimere il consenso al trattamento dei propri dati. Laddove l’Art. 8 del Regolamento (UE) Generale per la Protezione dei Dati europeo (GDPR) stabilisce che per quanto riguarda l’offerta diretta di servizi della società dell’informazione ai minori, il trattamento dei dati è lecito a partire dai 16 anni.

Le leggi nazionali possono derogare ma non al di sotto dei 13 anni. E così ha fatto l’Italia, portando la soglia a 14 anni. Una scelta che – come vedremo – comporta alcuni vantaggi, ma a certe condizioni, che dovrebbero seguire la via della co-regolazione attuata mediante lo schema della enforced self-regulation (posto che la semplice self regulation si è ormai rivelata insufficiente).

Spetta comunque al titolare del trattamento adoperarsi per verificare che il consenso sia effettivamente prestato o autorizzato dal titolare della responsabilità genitoriale, tenuto conto delle tecnologie disponibili (comma 2). Restano in tutti i casi salve (comma 3) le disposizioni nazionali in tema di diritto dei contratti (quali le norme sulla validità, la formazione o l’efficacia di un contratto rispetto a un minore).

Indice degli argomenti

Qual è la giusta età del consenso digitale del minore?

Quello della definizione dell’età minima per esprimere il consenso al trattamento dei propri dati è argomento delicato, che va letto alla luce della Convenzione sui diritti dell’infanzia e dell’adolescenza, del GDPR – entrato in vigore il 25 maggio 2018 – nonché del decreto legislativo n. 101 del 10 agosto 2018[1], di adeguamento del quadro regolatorio nazionale.

La scelta della età minima per il consenso invita infatti ad operare delicati bilanciamenti tra libertà di espressione, pensiero, associazione, e partecipazione dei minori alla vita di relazione e alla costruzione della comunità in cui vivono.

Essendo questi diritti esercitati anche in rete, occorre bilanciarli altresì con altri diritti, che sono specialmente quello all’informazione e quello alla protezione dei dati.

Ma v’è di più: considerati i rischi di dipendenze che si possono sviluppare online, è necessario altresì bilanciare tutti questi diritti certamente con il diritto al gioco, ma anche con la protezione della sicurezza e la tutela della salute e del benessere dei minori (si pensi ad es., al cyberbullismo).

“Le scelte” del legislatore delegato

La prima bozza di decreto legislativo[2], all’art. 6, rubricato “Consenso del minore in relazione ai servizi della società dell’informazione”, stabiliva che:

| 1. In applicazione dell’articolo 8, paragrafo 1, del Regolamento, il minore che ha compiuto i quattordici anni può esprimere il consenso al trattamento di propri dati personali in relazione all’offerta diretta di servizi della società dell’informazione. 2. In relazione all’offerta diretta dei servizi di cui al comma 1, il trattamento dei dati personali del minore di età inferiore a quattordici anni, fondato sull’articolo 6, paragrafo 1, lettera a), del Regolamento, è lecito a condizione che il consenso sia prestato o autorizzato da chi esercita responsabilità genitoriale 3. Il titolare del trattamento redige con linguaggio particolarmente chiaro e semplice, facilmente accessibile e comprensibile dal minore, le informazioni e le comunicazioni relative al trattamento che lo riguardi. |

Successivamente ai passaggi nelle commissioni parlamentari ed in specie al servizio giuridico, la formulazione dell’art. 2-quinquies del Codice della privacy (d.lgs. 30.6.2003, n. 196) dello schema di d.lgs (approvato il 22 maggio 2018) disponeva invece che:

| 1. Al consenso del minore al trattamento dei propri dati personali, in relazione ai servizi della società dell’informazione, si applicano le condizioni di cui all’art. 8, paragrafo 1, del Regolamento. In relazione a tali servizi, il trattamento dei dati personali del minore di età inferiore a SEDICI anni, fondato sull’articolo 6, paragrafo 1, lettera a), del Regolamento, è lecito a condizione che il consenso sia prestato o autorizzato da chi esercita responsabilità genitoriale. 2. In relazione all’offerta diretta dei servizi di cui al comma 1, il titolare del trattamento redige con linguaggio particolarmente chiaro e semplice, facilmente accessibile e comprensibile dal minore, le informazioni e le comunicazioni relative al trattamento che lo riguardi. |

Veniva dunque meno la possibilità per il minore (di 14 anni) di prestare direttamente il consenso al trattamento dei propri dati personali in relazione all’offerta diretta di servizi della società dell’informazione (vecchio comma 1). Possibilità ammessa dal Regolamento, che tuttavia il legislatore aveva deciso di non esercitare, eliminando la distinzione tra minore infra-quattordicenne – per il quale era necessario il consenso o l’autorizzazione genitoriale – e minore quattordicenne, in relazione al quale invece difettava tale tutela rafforzata.

La ragione di tale “révirement” si leggeva nella relazione illustrativa al d.lgs. del 22 maggio (v. Relazione tecnica, p. 6): trattandosi di consenso prestato per servizi quali i social network o i servizi di messaggistica, “la norma mira a tutelare il minore in quei contesti virtuali ove risulta maggiormente esposto a causa di una minore consapevolezza dei rischi insiti nella “rete””.

Con ulteriore successiva modifica, il d.lgs. 101/2018 riformula l’art. 2-quinquies riportandolo in larga misura alla prima versione, salvo accorpare in due commi i tre originari ed aggiungere alcune interposizioni (di seguito evidenziate in maiuscoletto).

Per cui, allo stato, la disposizione così recita:

| In attuazione dell’articolo 8, paragrafo 1, del Regolamento, il minore che ha compiuto i quattordici anni può esprimere il consenso al trattamento dei propri dati personali in relazione all’offerta diretta di servizi della società dell’informazione. Con riguardo a tali servizi, il trattamento dei dati personali del minore di eta’ inferiore a quattordici anni, fondato sull’articolo 6, paragrafo 1, lettera a), del Regolamento, e’ lecito a condizione che sia prestato da chi esercita la responsabilita’ genitoriale. In relazione all’offerta diretta ai minori dei servizi di cui al comma 1, il titolare del trattamento redige con linguaggio particolarmente chiaro e semplice, conciso ed esaustivo, facilmente accessibile e comprensibile dal minore, al fine di rendere significativo il consenso prestato da quest’ultimo, le informazioni e le comunicazioni relative al trattamento che lo riguardi. Art. 2-sexies (Trattamento di categorie particolari di dati personali necessario per motivi di interesse pubblico rilevante). |

Consenso all’uso dei dati a fronte di decisioni automatizzate

Come noto, il consenso esplicito (di cui all’art. 6 §1, lett. a) è una delle cause che legittima le decisioni automatizzate, incluse le profilazioni altrimenti vietate ai sensi dell’art. 22, §. 2 GDPR. Tuttavia, l’art. 22 non differenzia tra adulti e minori, sebbene il considerando 71 affermi che tali decisioni e profilazioni “non dovrebbero applicarsi ai minori”.

Come chiarito dal Working Party Art. 29, nelle “Linee guida sul processo decisionale automatizzato relativo alle persone fisiche e sulla profilazione ai fini del regolamento 2016/679” aggiornate al 6 febbraio 2018, la imprecisa formulazione della disposizione e il fatto che il divieto sia collocato in un considerando, non esclude che ai minori possano applicarsi profilazioni e decisioni automatizzate. Esso dunque ammette che possano valere, persino nei confronti dei minori, tutte le eccezioni individuate all’art. 22 §2 GDPR che legittimano le decisioni automatizzate e le profilazioni. E tali sono: la necessità di concludere un contratto (lett. a), la previsione autorizzatoria di una norma nazionale o UE (lett. b), e il consenso espresso (del minore) (lett. c).

A ben vedere, il consenso esplicito mal si presta a coprire decisioni basate su inferenze derivate dall’incrocio di migliaia di dati raccolti da svariate fonti (social network, dati di navigazione, ecc.) e processate da algoritmi che auto-apprendono (big data analytics). È difficile immaginare che l’interessato, per giunta minore, comprenda che la sua profilazione derivi non solo da dati che egli ha fornito direttamente, ma anche da quelli derivati o desunti da altri dati.

Cionondimeno, il WP appresta qualche, sebbene non rafforzata, cautela, richiamando il considerando 38 del GDPR, in base al quale:

| I minori meritano una specifica protezione relativamente ai loro dati personali, in quanto possono essere meno consapevoli dei rischi, delle conseguenze e delle misure di salvaguardia interessate nonché dei loro diritti in relazione al trattamento dei dati personali. Tale specifica protezione dovrebbe, in particolare, riguardare l’utilizzo dei dati personali dei minori a fini di marketing o di creazione di profili di personalità o di utente e la raccolta di dati personali relativi ai minori all’atto dell’utilizzo di servizi forniti direttamente a un minore. |

Ma specialmente, interessa il passaggio nel quale il WP Art. 29 afferma che (p. 32):

| «Dato che i minori rappresentano un gruppo più vulnerabile della società, le organizzazioni [recte: imprese] dovrebbero, in generale, astenersi dal profilarli per scopi di marketing. I minori possono essere particolarmente vulnerabili nell’ambiente online e più facilmente influenzabili dalla pubblicità comportamentale. Ad esempio, nei giochi online, la profilazione può servire per individuare i giocatori che l’algoritmo ritiene più propensi a spendere soldi, oltre a fornire annunci pubblicitari più personalizzati. L’età e la maturità del minore possono influenzarne la capacità di comprendere la motivazione che sta alla base di tale tipo di marketing o le sue conseguenze». |

Affermazioni importanti, che tuttavia portano il WP a concludere che la soluzione normativa più adatta sia quella dei codici di condotta, ovverosia della self-regulation.

Recita infatti l’art. 40.2, lett. g) RGPD che:

| 2. Le associazioni e gli altri organismi rappresentanti le categorie di titolari del trattamento o responsabili del trattamento possono elaborare i codici di condotta, modificarli o prorogarli, allo scopo di precisare l’applicazione del presente regolamento, … relativamente a: (…) g) l’informazione fornita e la protezione del minore e le modalità con cui è ottenuto il consenso dei titolari della responsabilità genitoriale sul minore |

Come si vede, l’adozione dei codici di condotta è facoltativa e su base volontaria. Ne segue che in caso di mancata adozione non sarà possibile attivare alcuna azione nei confronti del titolare o responsabile del trattamento per violazione delle regole di condotta.

Alcune considerazioni

Chi conosce i miei lavori sa che da qualche tempo mi occupo di rapporti tra diritto, ed in specie la regolazione pubblica, big data e scienze cognitive[3].

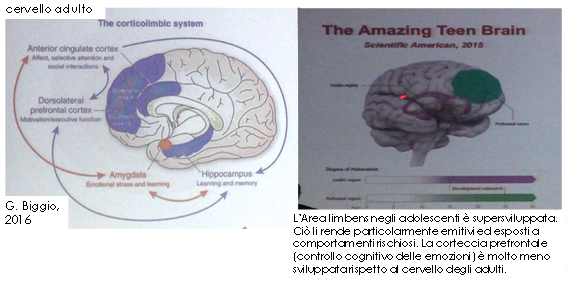

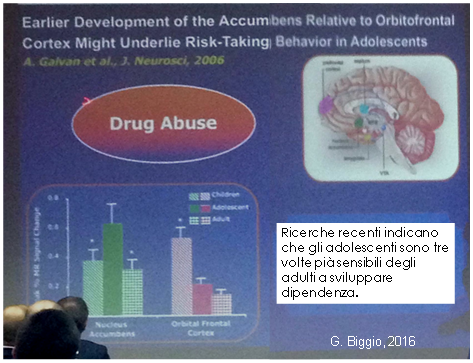

Alcune ricerche neuro-scientifiche (Biggio 2016) riportano che, a differenza di quello adulto, nel cervello dell’adolescente l’area limbens è molto sviluppata, il che lo rende particolarmente emotivo ed esposto a comportamenti rischiosi. Per contro, la corteccia prefrontale, deputata al controllo delle emozioni, è molto meno sviluppata che nel cervello adulto. Ricerche applicate al campo dell’abuso di droghe dimostrano, ad esempio, che ciò espone gli adolescenti ad essere tre volte più sensibili degli adulti a sviluppare dipendenze.

Inoltre, è noto che l’accesso ai contenuti digitali avviene già a partire dai 9 anni. Tuttavia, nella fascia di età 9-12 anni il minore si trova nella cd. fase del “pensiero concreto”, ossia non ha ancora sviluppato una coscienza critica autonoma; è solo nella fase medio-adolescenziale, tra i 14-16 anni, che comincia a valutare le proprie azioni, a comprenderne le conseguenze (anche etiche) e a stabilire relazioni più strutturate con l’altro.

Regolazione cognitive-based: evidenze empiriche sul comportamento online dei minori

La Commissione europea, nel 2015, allineandosi alle migliori prassi che vogliono le regolazioni pubbliche informate alle evidenze empiriche (Di Porto-Rangone 2015), ha commissionato un grosso studio behavioural mirante ad approfondire il comportamento dei minori online. Tale studio è stato pubblicato nel marzo 2016 col titolo “Study on the impact of marketing through social media, online games and mobile applications on children’s behavior”[4].

Condotto su un campione di bambini e adolescenti tra i 6 e i 12 anni[5], lo studio ne analizza il comportamento di fronte alle tecniche di marketing usate nei (25 più famosi) giochi online forniti sulle principali piattaforme (Facebook, Apple Store, Google Play ed altre “advergame”), con l’obiettivo di verificare come risponde il campione agli annunci pubblicitari e alle richieste di acquisti “in-app”.

In estrema sintesi l’indagine mostra che nella quasi totalità dei casi i giochi non presentano “misure protettive” dei bambini/adolescenti, come “ad alert” o simili, che consentano di distinguere tra pubblicità e gioco: la maggior parte di tali misure, pur presenti nei giochi, sono indirizzate ai genitori (come link alle politiche di privacy, termini e condizioni, strumenti di controllo genitoriale). Tutti i soggetti (6-12 anni) paiono influenzati specialmente dalla pubblicità di cibo ad alto contenuto energetico; mentre i più piccoli (8-9 anni) sarebbero i più vulnerabili agli acquisti “in-app”, nei quali spendono di più (p. 3, Executive summary).

Con riguardo alle misure protettive indirizzate direttamente ai bambini/adolescenti (non ai genitori), come ad esempio “warning message” o (l’inserimento di) “distracting task” – che hanno l’obiettivo di renderli consapevoli dell’intento commerciale della pratica di marketing, ovvero mirano ad interrompere il flusso del gioco – esse risultano particolarmente efficaci nel ridurre l’ammontare degli acquisti “in-app”.

Quanto al ruolo parentale, lo studio dimostra una elevata consapevolezza tra gli adulti circa i rischi cui sono esposti i bambini/adolescenti nel navigare online (cyberbullismo, immagini violente, data tracking, furto di identità digitale, pubblicità di stili di vita non sani, pubblicità mirata, messaggi prompt per fare acquisti “in-app”).

Tuttavia, risulterebbe una limitata preoccupazione per gli acquisti rispetto ad altri rischi della socializzazione online, motivo per cui gli adulti sarebbero poco interventisti a tale riguardo. Inoltre, la mediazione parentale sarebbe fortemente dipendente dallo status socio-economico della famiglia: ad un livello medio-elevato corrisponderebbe una mediazione più attiva.

Infine, lo studio conduce un assessment delle esistenti disposizioni regolatorie a livello europeo, per concludere che, pur nel variegato e stratificato panorama normativo, nella maggior parte degli Stati Membri lo schema prevalente è quello della self-regulation[6]. In base ad essa, le industrie predispongono codici di condotta in relazione alle attività di marketing indirizzate ai bambini/adolescenti. Lo studio non ritiene la self-regulation sufficiente a garantire la protezione dei minori, in quanto, alla luce delle evidenze empiriche raccolte, non permette al bambino/adolescente una facile identificazione dei contenuti commerciali e dell’intento persuasivo dei relativi messaggi.

La proposta dello studio è ricorrere ad un maggiore empowerment dei minori (non tanto dei genitori) attraverso la regolazione, per aumentare la loro capacità di riconoscere l’intento commerciale di una pratica di marketing e/o interrompere il flusso del gioco. (p. 6)

Lo studio non fornisce indicazioni definitive su quale debba essere l’età del consenso digitale del minore per l’offerta di servizi online. E del resto appare difficile fornire una indicazione definitiva unicamente sulla base delle evidenze di uno studio condotto su un campione che non rappresenta il comportamento dei minori italiani.

Raccogliere evidenze su un campione italiano

Ne segue che rispondere alla domanda se sia appropriata la scelta operata dal legislatore delegato all’articolo 2-quinquies Codice Privacy, ovverosia portare a 14 anni (anziché 16) il consenso al trattamento dei dati personali per l’offerta di servizi online (ed ammetterlo col consenso genitoriale per gli infraquattordicenni), richiede una risposta su più piani.

Sotto il profilo cognitivo, oltre ad una review della letteratura, già peraltro disponibile (si v. il Report dell’Agcom, Media e minori, 2018 del 16.1.2018)[7], sarebbe auspicabile un allineamento alle migliori prassi europee e raccogliere evidenze empiriche sul comportamento reale dei nostri minori online, ripartiti per fasce di età, in base allo sviluppo cognitivo (ad es., 9-12, 13-16). Ciò al fine di appurare la capacità di comprendere il contesto e le conseguenze della dazione del consenso; oltre ovviamente agli altri temi connessi alla profilazione e alle decisioni automatizzate (come eventuali bias cognitivi da conferma, sviluppo di dipendenze, rischio di discriminazioni algoritmiche, per citarne alcuni).

Le evidenze empiriche così raccolte potrebbero fornire indicazioni utilissime al legislatore in merito alla età del consenso digitale, ad esempio confermando che, con riguardo ai minori italiani, i 14 anni siano oggi una età sufficiente a garantire una attivazione dei meccanismi cognitivi di controllo utili ad assumere per lo più decisioni consapevoli online. Al contempo, le stesse evidenze potrebbero far emergere che le decisioni automatizzate (ad esempio un certo uso di alcune profilazioni) aumentano alcune dipendenze, generando rischi per la salute dei minori. E così procedendo.

14 anni come soglia di socializzazione digitale del minore

Sul diverso piano giuridico-sistematico, si ritiene che fissare la soglia del consenso digitale del minore a 14 anni possa presentare taluni vantaggi; purché l’abbassamento (rispetto alla soglia dei 16 anni del GDPR) possa essere abbinato ad altri strumenti, di cui si dirà subito appresso.

L’art. 2 della legge sul cyberbullismo[8] prevede il limite di età dei 14 anni affinché il minore vittima di tali atti possa autonomamente richiedere al titolare del trattamento dei dati, ovvero al gestore del sito internet o del social media l’adozione di provvedimenti a propria tutela, quali “l’oscuramento, la rimozione o il blocco di qualsiasi altro dato personale” che lo riguarda, (ancorché non costituisca ipotesi di reato[9]).

Da tale prospettiva, dunque, la scelta operata dall’art. 2-quinquies del Codice Privacy di portare l’età del consenso digitale a 14 anni, presenta il vantaggio di operare una uniformazione a livello ordinamentale, finendosi per individuare il compimento del 14° anno di età come il consolidamento di una serie di diritti e obblighi scaturenti dalla socializzazione digitale del minore.

Una maggiore responsabilizzazione delle piattaforme?

Per altro verso, il vantaggio indiretto che si è soliti attribuire all’abbassamento dell’età del consenso digitale è quella di una accresciuta responsabilizzazione delle piattaforme, degli emittenti e dei produttori di contenuti destinati ai minori, che sarebbero per ciò portati a prestare maggiore attenzione a quanto messo in circolazione (specie nelle piattaforme), ovvero a porre in essere accorgimenti tecnici atti a limitarne l’accesso da parte dei minori.

Da questo punto di vista, tuttavia, la disciplina relativa ai contenuti è molto diversificata (si pensi a quelli audiovisivi, sui quali vi è un controllo preventivo, rispetto a quelli prodotti dagli utenti). Così, ad esempio, la disciplina sul commercio elettronico (d.lgs. 70/2003) non prevede la responsabilità delle piattaforme (e in generale dei prestatori di servizi della società dell’informazione) per i contenuti ospitati che ledano l’integrità dei minori (salva la disciplina sul cyberbullismo).

Del pari, la attuale disciplina dei media audiovisivi, mentre assoggetta a controlli ex ante in favore dei minori nel caso il prodotto sia destinato alla distribuzione nelle sale cinematografiche, non ne prevede il controllo ove destinato alla distribuzione online (Agcom, Media e minori, cit., p. 45). Ancora in itinere è peraltro la modifica della Direttiva UE n. 2010/13[10] sull’audiovisivo, che a mio avviso dovrebbe applicarsi anche alle piattaforme che consentono la condivisione di video, pur se prodotti dagli utenti. Invece, ove approvata nella formulazione attualmente in circolazione, essa dovrebbe prevedere l’attivazione di strumenti che consentano agli utenti di segnalare i contenuti nocivi per i minori, nonché di consentire la verifica dell’età dell’utente e di attivare un controllo genitoriale.

Quanto alla disciplina dei “servizi della società dell’informazione” (Direttiva UE n. 2015/1535[11]), questa interessa tutti i contratti e servizi conclusi o trasmessi online. Ed è tale disciplina che viene più volte richiamata nella norma in commento. Il consenso del minore di cui parla l’art. 2-quinquies Codice Privacy è infatti quello relativo alla “offerta diretta” di quei servizi: (i) forniti senza la presenza simultanea delle parti (a distanza); ovvero (ii) in cui sia l’invio, sia la trasmissione e sia la ricezione avvengono mediante attrezzature elettroniche (per via elettronica) e in cui (iii) vi sia stata richiesta individuale di trasmissione di dati da parte del destinatario del servizio (art. 1 §1, lett. b)[12]. (Il consenso del minore ovviamente rileva anche al di fuori di tali ipotesi: si v. Pizzetti, 2.5.2018)

Se dunque il consenso del minore riguarda il consumo di servizi di questo tipo, il trattamento dei dati sarà lecito solo se il titolare avrà spiegato per iscritto (l’art. 2-qiunquies Cod. Privacy usa il termine “redige”) con linguaggio “particolarmente chiaro e semplice, conciso ed esaustivo, facilmente accessibile e comprensibile al minore … le informazioni e comunicazioni relative al trattamento che lo riguardi”.

L’aspetto più rilevante è che le modalità comunicative (semplificazione, chiarezza, concisione, esaustività, semplicità, ecc.) sono rese dal legislatore funzionali all’obiettivo di “rendere significativo il consenso prestato” dal minore. Ovverosia, si vuole che tale consenso, pur se reso da persona di cui si riconosce la abilità ad autodeterminarsi in rete, per le sue più limitate capacità anche cognitive di auto-controllo, e considerato che “la profilazione e il processo decisionale automatizzato possono comportare rischi significativi per i diritti e le libertà delle persone fisiche” (WP, Decisioni automatizzate, p. 5), progredisca per diventare, al pari di quello dell’adulto, “significativo”, ossia atto a legittimare il trattamento.

Auro-regolazione vs co-regolazione

L’auto-regolazione non è sufficiente a rendere il consenso del minore “significativo”. La strada maestra: la co-regolazione attuata mediante lo schema della enforced self-regulation.

Come anticipato, il GDPR affida alla sola auto-regolazione delle piattaforme e imprese online l’attuazione delle prescrizioni di cui al co. 2 art. 2-quinquies, volte ad educare il minore e a rafforzare la qualità del suo consenso nella fruizione dei servizi.

A fronte di questa blanda soluzione, assai più promettente sembra la via della co-regolazione, attuata mediante lo schema della enforced self-regulation, in base alla quale i codici di condotta sono elaborati mediante negoziazioni con l’industria e gli impegni ivi assunti a tutela dei minori da parte dei titolari e responsabili del trattamento sono resi vincolanti con decisione regolatoria. Poteri sanzionatori sono quindi attribuiti all’autorità di controllo (ad esempio, all’Agcom, ovvero al Garante per la protezione dei dati personali o al Comitato di cui all’articolo 68 del GDPR) nel caso di violazione degli impegni volontariamente assunti. In tale traiettoria si pongono sia la citata proposta di modifica della Direttiva 2010/13 (si v. ad esempio il considerando 30), sia – pur con le molte cautele già espresse – il GDPR (cfr. considerando 77 e gli articoli 40 §§ 3 e ss. e 41).

L’empowerment cognitivo del minore

Gli strumenti cui abbinare l’abbassamento dell’età del consenso digitale ai 14 anni, cui si faceva cenno, sono quelli di raising awareness del minore, o meglio di un suo empowerment cognitivo. In tal senso, la citata disposizione di cui al co. 2 dell’art. 2-quinquies, con un inciso introdotto nella versione finale del testo, come detto, introduce una serie di obbligazioni in capo al titolare del trattamento tese a “rendere significativo il consenso prestato dal minore”.

L’intervento preso di mira dalla disposizione in parola è uno di information disclosure, ossia un obbligo informativo a carico del titolare del trattamento, al quale è rimesso di “redigere le informazioni e comunicazioni relative al trattamento” che riguardano il minore. La norma si segnala per la speciale attenzione che il legislatore presta ai profili cognitivi del minore.

Difatti, riferendosi al tipo di linguaggio da usare (chiaro e semplice, conciso ed esaustivo) e alla modalità di espressione dell’informazione (facilmente accessibile e comprensibile) essa invita il titolare del trattamento ad avvalersi di due tecniche, quelle della semplificazione e della salienza, che si inscrivono nell’empowerment cognitivo (v. Fig. 1), in quanto mirano ad attivare scelte consapevoli, aiutando a ridurre il problema del sovraccarico informativo (information overload) o dell’accumulo informativo (F. Di Porto, 2017, p. 29, 135). Lungo questa linea si potrebbero promuovere anche tecniche di disclosure mirate e perfino personalizzate, pensate appositamente per i minori, da attivare ad esempio nel caso di contenuti più forti.

Da un punto di vista normativo-procedimentale, la scelta su come disegnare queste informazioni (o disclosure) a beneficio dei minori si dovrebbe ancora una volta giovare della raccolta di evidenze empiriche. Il che, specie alla luce delle recenti cronache di violazioni massive di dati e profili online (cc.dd. Datagate[13]) o dei rischi legati all’uso di certi giochi interattivi (come il caso della bambola tedesca Cayla), solleva l’urgenza di una consapevolezza effettiva e non presunta delle conseguenze del consenso digitale tra i minori.

Per cui, la enforced-self regulation suggerita più sopra dovrebbe costruirsi secondo uno schema collaborativo, con una preliminare sperimentazione che coinvolga imprese, consumatori (anche minori) e regolatore (in funzione di arbitro); e, sulla base delle risultanze di questa, definire successivamente i codici di condotta(co-regolazione), da rendersi applicabili (enforceable) da parte del regolatore (o anche del giudice).

| Fig. 1 – Ladder of disclosure intervention (based on proportionality) | ||

| disclosure by NUDGING | ||

| Exploits bias (bias preserving) Affects autonomy & preferences: (‘end paternalism’) Libertarian paternalism (low coercion but limits autonomy) Low-cost of design | Risk of State manipulation Lack of transparency Potentially successful in changing behaviors where other tools fail BUT Long run incapacitation |

| Disclosure Regulatory tool | Characters | CONS |

| in relation to AUTONOMY | ||

| disclosure by Cognitive Empowerment | ||

| Helps to overcome biases and emotional responses (truly de-biasing); Emphasis on self-education Preserves autonomy & preferences (‘means paternalism’) Low-cost of design | Cons: Aversion to being empowered Pros: May strengthen demand vis à vis supply May promote competition Can increase compliance with law and participation in public programs |

| traditional Disclosure regulation | ||

| Neutral towards individual preferences & cognitive context (rules apply to everyone disrespectful of incidence of biases) Preserves autonomy | Detailed impersonal general rules Not ensure effective comprehension Can exacerbate information asymmetry Information overload Accumulation problem |

– level of interference with individual autonomy +

Fonte: F. Di Porto, In praise of a co-regulatory disclosure approach to algorithms, IIC, Max Plank, 6/2018

____________________________________________________

- Recante “Disposizioni per l’adeguamento della normativa nazionale alle disposizioni del regolamento (UE) 2016/679 del Parlamento europeo e del Consiglio, del 27 aprile 2016, relativo alla protezione delle persone fisiche con riguardo al trattamento dei dati personali, nonché alla libera circolazione di tali dati e che abroga la direttiva 95/46/CE (regolamento generale sulla protezione dei dati)”, in GU n. 205 del 4.9.2018 (ultimo accesso: 5 settembre 2018). ↑

- Approvata dal Consiglio dei Ministri in data 20.3.2018 (ultimo accesso: 2 aprile 2018). ↑

- Cfr. da ultimo F. Di Porto, La regolazione degli obblighi informativi. Le sfide delle scienze cognitive e dei big data. ES, 2017. ↑

- Ultimo accesso: 5.4.2018. ↑

- I gruppi di bambini/adolescenti sottoposti ad esperimenti provenivano da Spagna e Olanda; mentre i focus group con minori e genitori sono stati condotti in 8 paesi (Spagna, Italia, Francia, Polonia, Olanda, Germania, UK e Svezia). Quanto all’indagine online con i genitori, questa ha riguardato un campione di 6.400 persone, divisi tra Spagna, Italia, Francia, Polonia, Olanda, Germania e UK (circa 800 interviste per paese). ↑

- Minoritarie sono invece le soluzioni di co-regulation (auto-regolazione dell’industria abbinata all’intervento pubblico) previste ad es., all’Art. 4.1 della Dir. sui Servizi media audio visivi (n. 2010/13/UE, AVMSD), che richiede altresì il controllo parentale per evitare che i minori siano esposti a contenuti dannosi. ↑

- Ultimo accesso: 5 aprile 2018. ↑

- Cfr. Legge 29 maggio 2017, n. 71 recante “Disposizioni a tutela dei minori per la prevenzione e il contrasto del fenomeno del cyberbullismo”, in G.U. n. 127 del 3.6.2017. ↑

- Va precisato tuttavia che nel caso del cyberbullismo resta fatta salva la possibilità per chi esercita la responsabilità sul minore di avvalersi di tali diritti in vece del minore. Tale possibilità, nel caso del consenso digitale, resterebbe in capo al solo quattordicenne. ↑

- Cfr. Proposta di Direttiva del Parlamento Europeo e del Consiglio recante “Modifica della direttiva 2010/13/UE relativa al coordinamento di determinate disposizioni legislative, regolamentari e amministrative degli Stati membri concernenti la fornitura di servizi di media audiovisivi in considerazione dell’evoluzione delle realtà del mercato”, COM/2016/0287 fin. (ultimo accesso: 5.4.2018). ↑

- Cfr. Dir. UE 2015/1535 del 9 settembre 2015 che prevede una procedura d’informazione nel settore delle regolamentazioni tecniche e delle regole relative ai servizi della società dell’informazione (codificazione), in GUUE L-241/1 del 19.9.2015 (Ultimo accesso: 5 settembre 2018). ↑

- Nel caso di servizi spuri (si pensi ad Uber), se la componente di “servizio della società dell’informazione” (la prenotazione, nel caso di specie) risulta non preponderante rispetto al servizio di base (quello di trasporto), allora essi non rientreranno nella disciplina dei servizi della società dell’informazione: cfr. Corte di giustizia (GS), causa C-434/15, Asociacion Profesional Elite Taxi/Uber Systems Spain SL, del 20.12.2017, ECLI:EU:C:2017:981, § 40. ↑

- Ultimo accesso: 5.4.2018. ↑