L’ultimo scandalo in fatto di riconoscimento facciale con intelligenza artificiale, ossia la scoperta del servizio Clearview AI con 3 miliardi di foto usato da alcune polizie degli Stati Uniti, conferma ancora una volta come questa tecnologia sia chiave di volta per i futuri equilibri tra tutela della privacy e sorveglianza di massa.

Non sorprende quindi che in Europa, secondo Euractiv, la Commissione europea stia prendendo in considerazione misure per imporre un divieto temporaneo di cinque anni alle tecnologie di riconoscimento facciale utilizzate da attori sia pubblici che privati.

C’è da chiedersi se le regole – ammesso che arrivino in tempo – siano argine sufficiente per questi rischi. Anche in Italia la situazione è nebulosa, dove al momento la tecnologia è usata in modo poco chiaro e con regole privacy ancora non definite con precisione.

Indice degli argomenti

Lo scandalo Clearview AI

Intanto infatti questa tecnologia continua a riscuotere interesse crescente. In un articolo bomba nel NYT, si scopre di Clearview AI, una piccola azienda fondata da Hoan Ton-That, un ingegnere autodidatta australiano di origini vietnamite, che ad oggi avrebbe raccolto oltre tre miliardi di immagini dal web rese “disponibili” alle forze dell’ordine per identificare i colpevoli di reato. Un’app rivoluzionaria, quanto controversa per il riconoscimento facciale che consente di fare una foto ad una persona, “caricarla” on line e vedere le foto pubbliche di quella persona, insieme ai link che riconducono al luogo dove sono apparse.

Il sistema – il cui backbone è un database che Clearview afferma di aver raschiato da Facebook, YouTube, Venmo e milioni di altri siti Web – va ben oltre qualsiasi cosa mai costruita dal governo degli Stati Uniti o dai giganti della Silicon Valley. Le forze dell’ordine federali e statali pare abbiano già usato l’app Clearview per gestire forme di criminalità, dal taccheggio, al furto di identità, dalle frodi con carta di credito, fino all’omicidio e ai casi di sfruttamento sessuale di minori. Sarebbe interessante provarlo, ma la richiesta d’accesso per il suo utilizzo risulta essere un’esclusiva per le forze di polizia e autorità come scelta aziendale.

Yashar Ali, un giornalista americano che collabora con HuffPost, NBC News e New York riferisce con un tweet di aver avuto due demo da Clearwiev

Il CEO di Clearview non opera da solo. Sempre secondo il NYT un collaboratore di Rudolph Giuliani, Richard Schwartz, sarebbe uno dei co-fondatori finanziati da Peter Thiel, già co-fondatore di Paypal e fondatore di Palantir, una società americana specializzata nell’analisi dei big data per le agenzie governative e per l’FBI. Il tutto con buona pace delle più elementari garanzie a tutela dei diritti degli ignari utenti social.

Prendere le foto dai social in questo modo (scraping) è vietato dalle policy di Facebook, ma secondo Clearview AI lo fanno tutti e Facebook non ha nulla da ridire.

Il “Libro bianco sull’intelligenza artificiale” dell’UE, qualche anticipazione

C’è da sperare che in Europa questi sistemi non saranno usati dalla polizia, grazie alle nostre più stringenti regole privacy; che però sono più permissive quando in gioco ci sono ragioni di pubblica sicurezza.

Questa tensione tra progresso delle applicazioni di riconoscimento facciale e regole si rafforzerà probabilmente nel 2020.

Nel “libro bianco sull’intelligenza artificiale” della Commissione europea, di prossima pubblicazione potrebbe essere infatti disposto un blocco temporaneo delle pertinenti applicazioni tecnologiche per un periodo che va dai 3 ai 5 anni, volto a favorire lo sviluppo di nuove regole e nuove metodologie in grado di sviluppare e valutare l’impatto etico delle conseguenti attuazioni in ottica di valutazione del rischio e sicurezza per i diritti e le libertà degli individui.

“Le regole future devono andare oltre quelle attuali e includere un bando limitato nel tempo per il riconoscimento facciale nei luoghi pubblici”.

Qualche anticipazione: secondo quanto afferma Euractiv, che ha potuto visionare il documento, eccezioni al divieto potrebbero essere fatte per i progetti di sicurezza, per la ricerca e lo sviluppo. Nel medesimo documento sarebbero contenute indicazioni circa gli obblighi da imporre sia agli sviluppatori sia agli utilizzatori dell’intelligenza artificiale e i paesi dell’Ue dovrebbero nominare autorità ad hoc per monitorare le nuove norme.

Il Libro Bianco ovviamente dovrà essere sottoposto ad un vaglio prima della decisione finale. Il commissario europeo per la concorrenza Margareth Vestager pare voglia presentare la proposta il prossimo mese.

Indubbiamente, sta crescendo la consapevolezza sui rischi dell’intelligenza artificiale, man mano che gli usi dannosi o potenzialmente tali si moltiplicano, sostenuti o meglio non ostacolati dalla perdurante assenza di un adeguato quadro regolatorio globale e condiviso. Al tempo stesso permane un certo cauto ottimismo sulla possibilità che l’umanità riesca a rendere “responsabile” ed “etica” l’AI.

Ed è intorno a questa dialettica che si è mosso il dibattito scientifico che ha caratterizzato le analisi relative anche allo sviluppo delle applicazioni di riconoscimento facciale, ben dettagliate nel Rapporto di Ai Now Institute e del Symposium 2019 delle fondatrici Kate Crawford e Meredith Whittaker tenutosi il 02 ottobre scorso allo Skirball Theatre della New York University.

Il documento pubblicato dall’ AI Now Institute, affermando e comprovando che il campo è “costruito su basi marcatamente instabili”, ha concluso chiedendo fermamente nuove leggi per limitare e migliorare l’uso della tecnologia di “facial recognition” in particolare in ambito rilevamento delle emozioni.

“Allo stesso tempo in cui vengono implementate queste tecnologie, un gran numero di studi sta dimostrando che non esiste … nessuna prova sostanziale che le persone abbiano questa relazione coerente tra l’emozione che provi e l’aspetto del tuo viso.” si legge.

Il dibattito sui rischi negli Usa e le linee guida della Casa Bianca

Le organizzazioni americane in difesa delle libertà civili e i gruppi sulla privacy hanno sollevato pesanti accuse e preoccupazioni sulle modalità con cui vengono raccolti i dati destinati a processi di apprendimento automatico.

Nelle varie audizioni tenutesi anche recentemente, i politici statunitensi hanno espresso grande preoccupazione per l’accuratezza e l’uso crescente del software di riconoscimento facciale e alla Camera si sta lavorando a un progetto di legge per limitare l’uso del riconoscimento facciale: il candidato alla presidenza Bernie Sanders ha chiesto di vietare ai dipartimenti di polizia di utilizzare il riconoscimento facciale e i legislatori stanno pianificando di introdurre un disegno di legge federale simile.

La Casa Bianca nel frattempo ha già messo in guardia le agenzie federali contro l’eccessiva regolamentazione che si sta muovendo attorno all’Intelligenza artificiale ed ha predisposto una serie di linee guida pensate per dare una governance chiara alle tecnologie di prossima generazione È necessario, afferma Trump «tenere in considerazione la non discriminazione, la trasparenza, la sicurezza» delle tecnologie senza però spingersi troppo avanti e «danneggiare la crescita e l’innovazione dell’Intelligenza artificiale».

Secondo quanto riferisce Margaret Harding McGill di Axios, i 10 principi normativi messi nero su bianco dall’amministrazione Trump costituiscono di fatto un segnale per le aziende sul fatto che la Casa Bianca è diffidente nell’imporre alla nascente tecnologia una regolamentazione troppo stringente.

Le Linee guida si articolano intorno a tre obiettivi generali:

- ottenere il contributo del pubblico e degli esperti, cercando commenti sui nuovi regolamenti e basando le decisioni sulle prove scientifiche;

- evitare una regolamentazione pesante conducendo analisi costi-benefici e valutazione dei rischi e coordinandosi con altri enti federali per mantenere la coerenza delle politiche;

- promuovere la fiducia nell’IA tenendo conto della non discriminazione, della sicurezza, della trasparenza e dell’equità in qualsiasi azione normativa.

Le direttive volute dall’amministrazione di Donald Trump certamente si possono considerare parte di una strategia più ampia indirizzata all’Europa e ad altri alleati per seguire la guida dell’America sulla politica dell’IA invece di lasciare che paesi come la Cina traccino il percorso; ma dall’altra parte, come contraccolpo sempre più città statunitensi stanno decidendo di vietare al loro governo locale di usare il riconoscimento facciale. San Francisco, la prima, seguita da Oakland, in California e Somerville, nel Massachusetts.

Stati uniti: sperimentazioni da parte delle forze polizia e non solo

I maggiori problemi si concentrano sulle sperimentazioni della tecnologia da parte della polizia e altre autorità specie militari: è noto che i ricercatori dell’esercito americano hanno sviluppato un’intelligenza artificiale e una tecnica di apprendimento automatico che produce un’immagine del viso visibile tramite una scansione termica del volto di una persona catturata in condizioni di scarsa illuminazione o di notte.

La Defense Forensics and Biometrics Agency supervisiona direttamente i lavori sulla tecnologia e due aziende – Ciano Systems, Inc. e Polaris Sensor Technologies – stanno lavorando in particolare su questa tecnologia per conto della DFBa.

Tali termocamere FLIR, Forward Looking Infrared, sono già impiegate attivamente su veicoli aerei e terrestri, in torri di guardia e presso punti di controllo a fini di sorveglianza e recentemente sembrerebbe stiano diventando disponibili per l’uso come telecamere da indossare alla stregua di un presidio di sicurezza.

Altre tecnologie vengono sviluppate direttamente da aziende hi-tech come Amazon e Microsoft e sono sempre più utilizzate dalle forze dell’ordine di tutto il mondo e non solo.

Ring, l’azienda che produce campanelli intelligenti e che detiene due brevetti per riconoscimento facciale, come scoperto dal Washington Post a fine agosto, ha stretto accordi con 400 dipartimenti di polizia in tutti gli Stati Uniti affinché le forze dell’ordine possano avere accesso ai feed delle telecamere inserite nei campanelli per renderli, appunto, “smart”. E trasformare ogni vicinato nel “new neighbourhood watch” d’America.

Scrive Drew Harwell: “Gli accordi consentono alla polizia di richiedere automaticamente i video registrati dalle videocamere dei padroni di casa all’interno di una certa area e di un certo lasso temporale, aiutando gli ufficiali ad accedere al materiale prodotto dai milioni di videocamere connesse a Internet installate dall’azienda in tutto il mondo. Gli ufficiali non ricevono accesso a video in diretta, e i padroni di casa possono declinare le richieste, che Ring invia via e-mail ringraziandoli per ‘rendere il vicinato un posto più sicuro”

I principali fornitori di riconoscimento facciale includono Accenture, Aware, BioID, Certibio, Fujitsu, Fulcrum Biometrics, Gemalto, HYPR, Idemia, Leidos, M2SYS, NEC, Nuance, Phonexia e Smilepass.

Anche il dipartimento di polizia di Miami-Dade (MDPD), la più grande forza di polizia in Florida, si avvale della medesima tecnologia. Secondo i documenti depositati presso il comitato per la sicurezza pubblica e la riabilitazione della contea, MDPD vorrebbe stipulare un memorandum permanente di accordo con il dipartimento dello sceriffo di Pinellas Bob Gualtieri per utilizzare il suo sistema di confronto ed esame delle analisi del viso – noto anche come FACES.

Uno degli utilizzi più frequenti: scoprire l’identità di persone fermate e prive di documenti.

Ugualmente, nel 2018, il dipartimento di polizia di Orlando ha iniziato ad usare Rekognition, un programma di scansione facciale di Amazon che utilizza filmati di telecamere di sicurezza in diretta; a dispetto dei numerosi studi che avevano messo in guardia sul fatto che Rekognition non fosse in grado di identificare le donne dalla pelle scura e persone di età compresa tra 18 e 30 anni. A maggior ragione l’attendibilità diminuiva quando i sospettati erano invecchiati, avevano un gemello, si erano sottoposti ad interventi chirurgia plastica, o semplicemente indossavano occhiali da sole.

Come funziona il riconoscimento facciale

Il riconoscimento facciale è un processo di identificazione o verifica dell’identità di una persona. Cattura, analizza e confronta modelli basati sui dettagli biometrici della persona.

Si può riassumere in tre fasi:

- Il processo di rilevamento dei volti è un passaggio essenziale in quanto rileva e individua i volti umani in immagini e video.

- Il processo di acquisizione del volto trasforma un’informazione analogica (un volto) in un insieme di informazioni digitali (dati) basate sulle caratteristiche facciali della persona.

- Il processo di corrispondenza dei volti verifica se due volti appartengono alla stessa persona.

Oggi è considerata la più naturale di tutte le misurazioni biometriche.

Nel caso della biometria facciale, un sensore 2D o 3D “cattura” un viso. Quindi lo trasforma in dati digitali applicando un algoritmo prima di confrontare l’immagine acquisita con quelle conservate in un database.

Questi sistemi automatizzati possono essere utilizzati per identificare o verificare l’identità degli individui in pochi secondi in base alle loro caratteristiche facciali: spaziatura degli occhi, ponte del naso, contorno delle labbra, orecchie, mento, ecc.

Possono anche farlo in ambienti dinamici ed instabili.

Perché il riconoscimento facciale?

La biometria facciale continua ad essere il punto di riferimento biometrico preferito.

Questo perché è facile da implementare. Non vi è alcuna interazione fisica richiesta dall’utente finale.

E i processi di rilevamento e corrispondenza dei volti per la verifica / identificazione sono estremamente rapidi (accurati cosa diversa).

Stati Uniti, la fallacia delle tecnologie di sorveglianza

Jennifer Valentino-DeVries, reporter del New York Times, partendo da resoconti dettagliati e documentati di centinaia di fatti realmente accaduti in Florida, ci offre un ottimo “check” delle problematiche sottese all’utilizzo e all’attendibilità del riconoscimento facciale, dei rischi e benefici a questo connessi da parte delle Forze dell’Ordine.

Ne emerge un quadro piuttosto critico che rivela un sistema a dir poco “claudicante” quanto a supervisione e trasparenza.

In Florida, il riconoscimento facciale è sedimentato e “ben sovvenzionato” da tempo. Dal 2001, l’ufficio dello sceriffo della contea di Pinellas (PCSO) gestisce uno dei più grandi database di riconoscimento facciale in America e numerosi dipartimenti di polizia in tutto lo stato hanno optato per l’accesso a tali informazioni: a partire dal 2016, 243 dipartimenti di polizia in Florida avevano già accesso al database della Contea di Pinellas, che estrae le foto dai database delle patenti di guida e da altri set di dati disponibili al pubblico. Ciò malgrado già nel 2016, diversi studi avessero dimostrato che il database era in grado di produrre falsi positivi tali da potersi facilmente prestare ad abusi di notevole impatto. I test realizzati hanno riscontrato che persino i sistemi di riconoscimento facciale più performanti identificavano erroneamente le persone di colore con tassi di inesattezza da 5 a 10 volte superiori rispetto ai bianchi.

Anche il Center on Privacy and Technology del Georgetown University Law Center tra gli altri avvertiva che le linee guida sul riconoscimento facciale di Pinellas non garantissero gli standard minimi di tutela dei diritti degli individui “prescindendo addirittura dal “ragionevole sospetto di un crimine” per essere comunque autorizzati a cercare qualcuno nel database”.

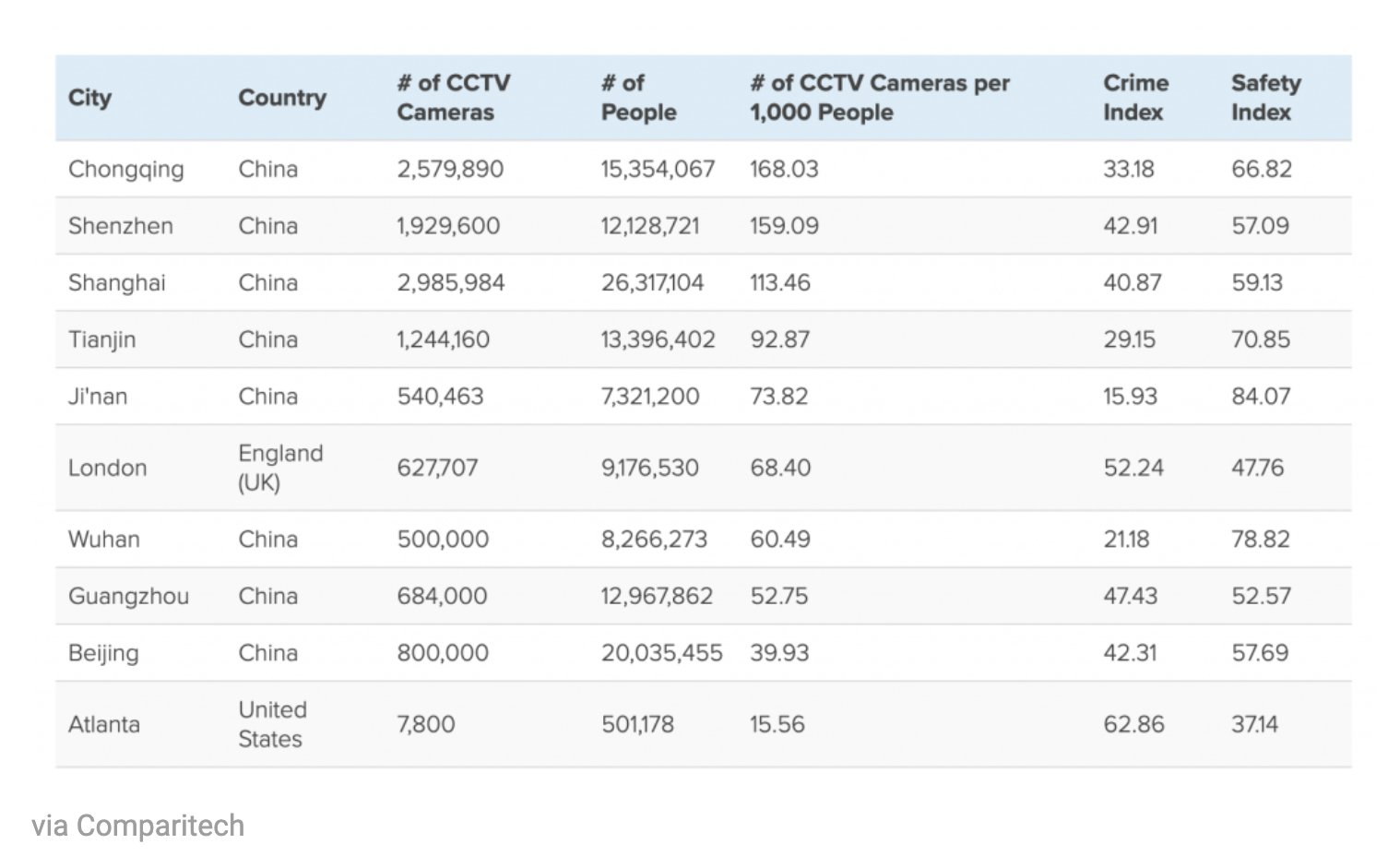

Patrick Grother, figura di spicco e alla guida dei test del NIST, ha affermato che potrebbero esserci diverse cause a monte del bias incidente sulla pelle più scura. Una certamente è la qualità delle foto: immagini di qualità scadente contribuiscono senza dubbio a disallineamenti e l’illuminazione fioca, i volti rivolti ad un angolo o mascheramenti minimi come cappelli da baseball o occhiali da sole possono ostacolare la precisione di un risultato. In Cina, le forze dell’ordine hanno limitato la portata di questo problema installando telecamere ad alta definizione intrusive con luci intense a livello del viso e legando i sistemi di riconoscimento facciale ad altre tecnologie di AI.

Riconoscimento facciale, utilizzi: non solo USA e Cina

L’Australia sembra stia predisponendo un “imponente” sistema di riconoscimento facciale che dovrebbe passare al vaglio anche patente di guida e passaporto di tutti i cittadini.

L’India insegue la Cina sul modello della schedatura biometrica totale progettando la realizzazione del “sistema di riconoscimento facciale per le forze dell’ordine più vasto del mondo”, che mira a creare un sistema centralizzato che sia collegato anche a passaporti, impronte digitali e altre banche dati.

Anche in Europa, sebbene nell’alveo del quadro normativo esistente, la tendenza è di incrementarne l’uso, quanto meno a fini di sicurezza nazionale e di ordine pubblico, lotta al terrorismo e prevenzione dei reati.

Al momento i sistemi massivi sono solo sperimentali, ad eccezione del Regno Unito che, anche alla luce della Brexit, è già uscita dalle sperimentazioni.

Così è nel Galles del Sud, mentre è di gennaio l’annuncio dell’avvio anche a Londra (tra le polemiche delle associazioni per i diritti civili) dove il sistema serve a riconoscere i ricercati tra la folla tramite videocamere di sorveglianza. Secondo la polizia l’efficacia è del 70% con falsi positivi dell’1 per mille. L’accuratezza è del 19% invece per uno studio indipendente della Essex University citato dal Guardian.

E secondo la British Safety Industry Authority (BSIA) nel 2013 nel Regno Unito erano attive 5,9 milioni di telecamere di sorveglianza.

In Germania sono stati avviati i primi test per l’utilizzo del riconoscimento facciale nelle stazioni ferroviarie.

Il ministro degli Interni tedesco Horst Seehofer prevede di utilizzare il riconoscimento facciale automatico in 134 stazioni ferroviarie e 14 aeroporti, secondo un rapporto pubblicato il 3 gennaio.

Sebbene il Ministero non abbia confermato ufficialmente le misure, un portavoce del governo, interrogato da Euractiv, ha dichiarato che era al vaglio un emendamento alla legge federale sulla polizia per fornire alla stessa “migliori possibilità tecniche e, ove possibile e ragionevole, estese responsabilità”.

Le opposizioni non mancano e anche il leader dei socialdemocratici (SPD), Saskia Esken, ha messo in guardia da tali falsi positivi e lo ha reso chiaro su Twitter il 4 gennaio:

E con il disegno di legge in mano al ministero della giustizia guidato da SPD, i socialisti avranno senza dubbio un ruolo chiave.

In Francia con il placet della CNIL è stato autorizzato il riconoscimento facciale negli aeroporti di Orly e Roissy, e presso la Gare du Nord per l’imbarco a bordo dell’Eurostar, ma una proposta di legge del 2016 ne suggerisce l’utilizzo per la lotta al terrorismo.

Nizza è stata descritta recentemente da Politico Europe come “il laboratorio del riconoscimento facciale” disponendo di 2600 videocamere di sorveglianza disseminate in tutto il territorio cittadino. Finora ci sono stati solo test della tecnologia, giudicati di totale successo dal governo.

L’avvio ufficiale continua a essere rinviato alla luce dei sospetti di incompatibilità con il Gdpr.

A Nizza c’è anche progetto di sperimentazione nel liceo Les Eucalyptus, a cui si aggiunge quello in un altro istituto di Marsiglia: pare che l’ingresso a scuola avverrebbe per riconoscimento biometrico previo consenso degli studenti, e la tecnologia verrebbe dal colosso statunitense Cisco.

Ed è noto il caso della Svezia dove il DPA svedese ha multato un comune di 200.000 SEK (circa 20.000 euro) per uso illegittimo della tecnologia di riconoscimento facciale nel monitoraggio della frequenza degli studenti di un Istituto scolastico svedese della Svezia settentrionale. Il DPA svedese ha concluso che il test violava diversi articoli nel GDPR e ha inflitto un’ammenda al comune di circa 20.000 euro.

Riconoscimento facciale in Italia, il Sari: situazione nebulosa

Anche in Italia ci sono casi degni di attenzione. Non ci sono utilizzi massivi con videocamere di sorveglianza, come quelli sperimentali in Francia e attuali nel Regno Unito, ma ci sono già applicazioni specifiche e mirate a opera delle forze dell’ordine.

Un’inchiesta di Raffaele Angius e Riccardo Coluccini, pubblicata su Wired, ha tentato di ricostruire la nebulosa storia di Sari, il sistema automatico di riconoscimento delle immagini in dotazione alla polizia di Stato.

Il Sari ha 16 milioni di record e 10 milioni di foto, 9 milioni di profili – da fonti ufficiali del ministero dell’Interno aggiornate a fine 2018 – di cui all’80 per cento di stranieri. Non c’è chiarezza su cosa siano esattamente questi record, né come siano alimentati (tra le ipotesi: passaporti, Sistema dattiloscopico europeo Eurodac, foto scattate durante le manifestazioni e cortei), tanto che il 23 gennaio 2020 c’è stata un’interrogazione parlamentare a riguardo da parte di Filippo Sensi (PD).

Tra gli utilizzi concreti riportati dalla polizia, il Sari è servito a scoprire l’identità di rapinatori ripresi dalle videocamere di sorveglianza (ad esempio nel 2018 uno che colpiva le farmacie a Milano).

Sembrerebbe inoltre che SEA la compagnia che gestisce gli aeroporti di Linate e Malpensa abbia previsto un investimento di 17 milioni di euro per acquistare sistemi di riconoscimento biometrico facciale “volti” ad identificare i passeggeri in modo veloce durante l’imbarco.

E il garante privacy italiano?

A fronte di questo, il Garante Privacy nel 2018 ha accolto la posizione del ministero dell’Interno secondo cui non si tratta di nuovo trattamento di dati personali e che è il riconoscimento facciale è solo un’evoluzione del riconoscimento delle impronte; ha emanato quindi un provvedimento di autorizzazione.

Siamo però ancora nell’attesa del regolamento del garante privacy sul trattamento dati biometrici.

Dati genetici e biometrici, manca all’appello l’intervento del Garante

Lo studio Nist

Tra gli studi, di particolare rilevanza, c’è quello del National Institute of Standards and Technology, il laboratorio federale noto come NIST che sviluppa standard per le nuove tecnologie, il quale, confermando precedenti analisi di ricercatori giunte alle medesime conclusioni, ha esaminato algoritmi che provenivano da una serie di importanti aziende tecnologiche e appaltatori di sorveglianza, tra cui Idemia (sviluppatore del sistema di Pinellas), Intel, Microsoft, Panasonic, SenseTime e Vigilant Solutions (assente dalla lista Amazon che sviluppa il Rekognition), riportando “prove empiriche” sul fatto che la maggior parte degli algoritmi di riconoscimento facciale presentano “differenziali demografici” che possono peggiorare la loro precisione in base all’età di una persona, genere o razza.

Gli asiatici e gli afroamericani avevano fino a cento volte più probabilità di essere identificati erroneamente rispetto agli uomini bianchi, a seconda del particolare algoritmo e del tipo di ricerca. I nativi americani avevano il più alto tasso di falsi positivi di tutte le etnie, secondo lo studio del NIST.

Gli algoritmi rivelavano alti tassi di errore specialmente per le ricerche “one-to-one” (utilizzate per sbloccare un telefono o la verifica di un passaporto) ma non ne erano immuni neppure quelle “one-to-many”, utilizzato dalla polizia per cercare il volto di un sospetto a partire dal set delle foto della patente di guida di asiatici, afroamericani, nativi americani e isole del Pacifico.

Va detto che dal Rapporto emerge anche come alcuni specifici algoritmi abbiano prodotto pochi e trascurabili errori, ma la disparità di precisione tra i diversi sistemi rimane comunque enorme.

Il team NIST ha testato i sistemi con circa 18 milioni di foto di oltre 8 milioni di persone, tutte provenienti da banche dati gestite dal Dipartimento di Stato, dal Dipartimento per la sicurezza nazionale e dall’FBI.

Secondo un rapporto del 2016 di Frost & Sullivan il mercato globale di riferimento varrà 6,15 miliardi di dollari nel 2019. NEC stima che nel prossimo decennio raggiungerà i 20 miliardi di dollari.

Si tratta, però, di una tecnologia ancora soggetta ad errori e praticamente priva di adeguata regolamentazione oltre che comprensione pubblica.

Garbage in, garbage out

Malgrado questo, i sistemi di riconoscimento restano operativi; i poliziotti effettuano più di 8000 ricerche FACES al mese, e PCSO non sembra effettuare praticamente alcun audit per testare l’accuratezza del sistema. All’inizio di quest’anno, Orlando Sentinel ha riferito che oltre 17 agenzie federali – tra cui l’FBI e l’ICE – stavano usando FACES.

“Dipende dalla qualità dell’immagine”, ha dichiarato al NY Times Jake Ruberto, specialista dell’assistenza tecnica nell’ufficio dello sceriffo della Contea di Pinellas, che aiuta a gestire il programma di riconoscimento facciale. “Se metti immondizia nel sistema, recupererai la spazzatura”.

Le foto inserite nei database spesso sono non sono recenti e le persone cambiano col passare degli anni: la foto di uno dei due attentatori di Boston risaliva ai suoi 16 anni, ed è noto che un ragazzo cambia velocemente la struttura facciale; per questo non era stato riconosciuto.

L’opinione pubblica continua a fidarsi della tecnologia, nonostante tutto

È interessante apprendere che un nuovo sondaggio del Pew Research Center condotto dal 3 al 17 giugno 2019 evidenzi come malgrado gli studi pubblicati, la maggioranza degli americani (56%) si fidi delle forze dell’ordine e del conseguente utilizzo di queste tecnologie. Una percentuale simile (59%) afferma addirittura che il rischio di errore è accettabile in vista della miglior tutela dalle minacce alla sicurezza negli spazi pubblici.

Clare Garvie, del Centro di privacy e tecnologia della Georgetown Law, ha detto: “Prendi l’applicazione più pericolosa di questa tecnologia, e ci sono buone probabilità che qualcuno la proverà (perché nessuno avrà interesse ad impedirlo)”.

Intelligenza artificiale e riconoscimento facciale: il dibattito nella Ue

In Europa, la divulgazione del progetto di Libro bianco della Commissione fa seguito a un periodo di discussione pubblica su come affrontare le sfide future dell’intelligenza artificiale: la relazione, pubblicata a giugno dal gruppo ad alto livello della Commissione sull’intelligenza artificiale, riporta che l’intelligenza artificiale presenta problemi etici “black swan”: “Maggiore è l’impatto e/o la probabilità di un rischio creato dall’IA, più forte dovrebbe essere la risposta normativa appropriata”. Il documento ha anche suggerito che l’UE dovrebbe considerare la necessità di un nuovo regolamento per “garantire un’adeguata protezione dagli impatti negativi” dei sistemi di intelligenza artificiale sui diritti fondamentali. Tra questi viene menzionato l’utilizzo dei sistemi di riconoscimento facciale.

La relazione prosegue affermando che “un approccio basato sul rischio suggerisce che le preoccupazioni legate alle tecnologie di intelligenza artificiale dovrebbero essere tenute in considerazione alla luce di possibili incognite e “cigni neri”, che si riferiscono a eventi molto rari, imprevisti e di forte impatto tali da imporre “una valutazione regolare su questi argomenti”.

Da qui l’ipotesi, al vaglio della Commissione, dello stop da tre a cinque anni delle tecnologie di sorveglianza, visto probabilmente da Bruxelles come un modo per comprendere come gestire i rischi insiti nella velocità vertiginosa con cui tali tecnologie vengono adottate, allo stesso tempo auspicando una cospicua risoluzione delle marginalità di errore insite in esse favorita dai progressi della tecnica e dalla selezione dei player.

Le immagini si descrivono da sole?

La fede attribuita a vari livelli nel riconoscimento facciale si basa di fatto su un assunto tanto semplice quanto errato: che sia possibile per un’immagine descrivere sé stessa.

Nel loro saggio sul progetto, “Excavating AI: The Politics of Images in Machine Learning Training Sets”(2019) Kate Crawford e Trevor Paglen ce ne forniscono una chiara espressione e lo studio merita un’attenta lettura e comprensione atutto vantaggio della consapevolezza di ciascuno:

“Le immagini non si descrivono da sole. È una caratteristica che gli artisti hanno esplorato per secoli. Agnes Martin crea un dipinto a forma di griglia e lo chiama “Fiore Bianco”, Magritte aggiunge al dipinto di una mela le parole “Questa non è una mela”. Vediamo le stesse immagini in modo diverso a seconda di come vengono etichettate. Il circuito tra immagine, etichetta e referente è flessibile e può essere ricostruito in un qualunque numero di modi per fare cose differenti. Ancora più importante è che quei circuiti possano cambiare nel tempo con il mutare del contesto culturale di un’immagine, e significare cose diverse a seconda di chi guarda, e di dove sono situati. Le immagini sono aperte a interpretazioni e re-interpretazioni”

“Vediamo le stesse immagini in modo diverso a seconda di come vengono etichettate”. E ciò è esattamente quanto ha dimostrato ImageNet Roulette, il software-provocazione lanciato dagli stessi studiosi all’interno di un più ampio tentativo di sensibilizzare l’opinione pubblica sulle controindicazioni dell’AI attraverso l’arte, e che consentiva di associare un’etichetta ricavata da uno dei database di immagini più usati al mondo per affinare il machine learning, ImageNet, a una propria fotografia, scattata sul momento o presa da un proprio archivio. Nel mio caso, è bastato indossare una camicia e una giacca per passare, nel catalogo composto dall’algoritmo, da “copertura” ad “amministratore”.

Conclusioni

La mancanza di trasparenza sull’uso effettivo della tecnologia limita infatti le opportunità di analisi delle sue fondamentali implicazioni sui diritti umani.

Alcune di queste implicazioni derivano senza dubbio dalla perdurante mancanza di precisione della tecnologia medesima: una precisione che è aumentata ma che è ancora caratterizzata da un certo tasso di errore, che può negativamente incidere sui diritti fondamentali. Gli algoritmi non sono neutrali imparziali ed oggettivi e molto difficilmente le loro implementazioni potranno tradursi in mere scelte amministrative, di ordine pubblico e sicurezza nazionale o di business. Credere il contrario è ingenuo e fuorviante.

Non essendoci, generalmente ovunque, un quadro normativo che limiti le applicazioni di questa tecnologia, per le forze dell’ordine come per le organizzazioni private, il rischio pesante è, come scrive il giornalista Fabio Chiusi “rendere la sorveglianza totale parte integrante e naturale del panorama della democrazia contemporanea”. Uno scenario, a mio avviso, deplorevole.

Lo stop dell’UE, in tal senso, può essere visto come un primo segnale di buon senso in vista di una seria ed informata discussione democratica sul ruolo del riconoscimento facciale nella società, ma non basta. La vera sfida si gioca sulla governance del digitale; ovvero sulla capacità di addivenire quanto prima a sistemi regolatori condivisi ed efficaci, frutto di approcci multistakeholder autentici, orientati sui rischi del trattamento delle informazioni non solo individuali bensì anonimizzate e aggregate che, anche alla stregua delle precedenti considerazioni, appaiono estremamente importanti quanto foriere di evidenti e non ulteriormente tollerabili discriminazioni sui gruppi e sulle minoranze. Sono le regole del gioco che fanno la differenza. La nostra società da grande cosa vuole essere? Cosa vuole fare? Qual è il nostro progetto al di là di farci un po’ gli affari nostri?