Il settore dell’Intelligenza Artificiale è territorio di ampie sfide ma anche di interrogativi legati alle diverse ripercussioni sui diritti e le libertà delle persone.

Pertanto le linee guida della Commissione europea per un’intelligenza artificiale affidabile, aggiornate a settembre da uno studio del centro studi del Parlamento europeo, presentano delle concrete prospettive per garantire lo sviluppo di sistemi di AI leciti ed etici, in una prospettiva che potremo definire come “umano centrica” basata su principi e valori europei.

Per garantire un’armonizzazione coerente delle linee guida e evitare divergenze applicative all’interno dell’Ue servono però interventi normativi coordinati a livello europeo e nazionale.

Indice degli argomenti

Intelligenza artificiale: tra benefici, criticità ed etica

Il tema inerente allo sviluppo e della regolamentazione dell’intelligenza artificiale presenta infatti implicazioni della massima rilevanza, avendo ripercussioni nei più svariati settori, da quello economico, a quello ambientale, sanitario e sociale.

In particolare nel settore della sanità, ad oggi esistono sistemi di apprendimento automatizzato basati sulle immagini che permettono di individuare con più esattezza diverse patologie in fase precoce così da permettere di intervenire tempestivamente aumentando le probabilità di successo della terapia

Nel settore automobilistico, l’IA è sempre più presente nella progettazione e sviluppo di veicoli autonomi che siano in grado di implementare le prestazioni delle macchine mediante interconnessione con infrastrutture, semafori e in generale al network delle smart city per finalità connesse ad una più agevole gestione della guida.

Ma anche nel settore giuridico, abbiamo assistito negli ultimi anni alla diffusione dell’IA attraverso lo sviluppo di quei meccanismi di cosiddetta“giustizia predittiva”. Si tratterebbe di sistemi che mediante il ricorso ad algoritmi (e quindi attraverso l’elaborazione di contenuti decisionali, testi di sentenze, decreti, atti del giudice in genere e banche dati giurisprudenziali) saranno in grado di “predire” l’orientamento del ragionamento del Giudice.[1]

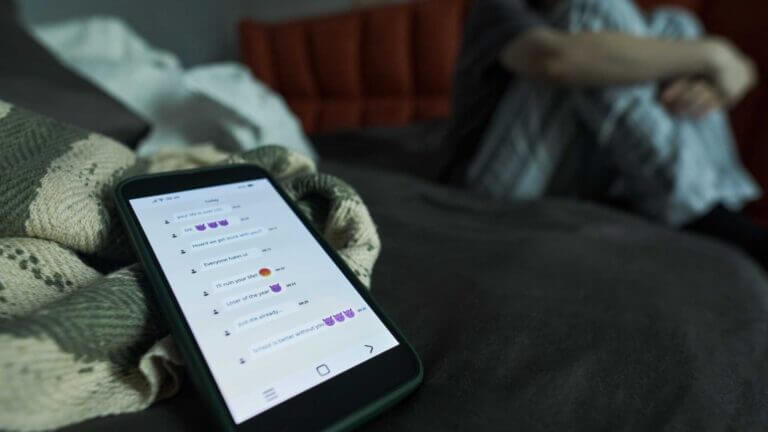

Se da un lato i benefici di questi sistemi basati sull’intelligenza artificiale sono evidenti, dall’altro non sono mancate critiche connesse ai rischi legati alla protezione dei dati personali e alle ripercussioni sui rischi per i diritti e le libertà degli interessati, con particolare riferimento ai casi in cui i sistemi di IA ricorrano a processi decisionali automatizzati. Non da meno diverse criticità sono state sollevate sotto il profilo etico del funzionamento delle nuove tecnologie, con particolare attenzione ai possibili “condizionamenti” esterni anche connessi a profili di incompletezza nella progettazione o a modelli di governance inadatti che potrebbero portare a discriminazioni dirette o indirette dell’individuo.

La dimensione etica: la salvaguardia della dignità umana e principio di non discriminazione

Il tema dell’intelligenza artificiale non può prescindere anche dalla disamina dei profili etici connessi al funzionamento di algoritmi riferibili a procedimenti decisionali automatizzati. “Le intelligenze artificiali del futuro” riporta il Post,“saranno costruite in modo da raggiungere uno specifico obiettivo e potrà darsi che nel portare a termine il loro compito si trovino davanti a una scelta, anche piccola: per avere la sicurezza che non commettano errori, i loro programmatori dovranno prendere in considerazioni tutte le possibili implicazioni di una data scelta in un dato contesto e così prevedere possibili casi in cui le macchine potrebbero comportarsi in modo sbagliato dal punto di vista etico”[2].

Celebre caso nella filmografia americana che espone in modo chiaro le possibili applicazioni di tale risvolto operativo dei sistemi di IA è la vicenda rappresentata nel film “Io robot”, 2014 diretto da Alex Proyas, ove un robot che potendo salvare solo una persona da un auto che stava affondando in un lago, sceglie di salvare una persona adulta, anziché una bambina, in ragione di un calcolo probabilistico generato dall’algoritmo che lo aveva programmato, che aveva assegnato alla possibilità di riuscita del salvataggio della ragazzina una probabilità più bassa.

Al fianco di tali implicazioni, una preoccupazione importante riguarda le possibili ripercussioni sulla dignità umana e sul principio di non-discriminazione. Si pensi a quando, nel 2015 il sistema di riconoscimento immagini di Google riconosceva alcune persone di colore catalogandole come “gorilla”, oppure al funzionamento di alcuni processi applicati nelle aziende inerenti alla fase di selezione del personale. Nel caso specifico di alcuni istituti scolastici era stato rilevato che le scuole impiegavano più donne che uomini. In ragione di ciò l’algoritmo sviluppava “rapidamente una preferenza per le candidate donne, e, se anche si rendessero i curricula neutrali dal punto di vista del genere, ciò non risolverebbe il problema. L’algoritmo individuerebbe infatti rapidamente altri modi per spiegare perché i curriculum femminili vengono selezionati più spesso, magari prediligendo determinati hobby femminili e assegnando meno punti ai curriculum che elencano passatempi tradizionalmente maschili.”[3]

Sulla base di queste considerazioni si rivela essenziale collocare l’intelligenza artificiale in una dimensione etica, che non possa prescindere dal rispetto dei diritti fondamentali delle persone, mirando a rafforzare le loro capacità e non anche a sostituirsi agli stessi.

Prospettive di sviluppo per un’intelligenza artificiale affidabile

In questo contesto quindi, la prospettiva avanzata dalle linee guida espresse dalla Commissione nella comunicazione al Parlamento Europeo, al Consiglio, al Comitato economico e sociale europeo e al Comitato delle Regioni[4] sottolinea la necessità di creare una strategia europea per garantire l’etica delle intelligenze artificiali fondata su un approccio umano centrico.

Secondo la definizione che ne viene data nelle linee guida, tale approccio “è volto a garantire che i valori umani rivestano un ruolo centrale nelle modalità di sviluppo, distribuzione, utilizzo e monitoraggio dei sistemi di IA, garantendo il rispetto dei diritti fondamentali, tra cui quelli sanciti nei trattati dell’Unione europea e nella Carta dei diritti fondamentali dell’Unione europea, accomunati dal riferimento a un fondamento condiviso radicato nel rispetto della dignità umana, nei quali l’essere umano gode di uno status morale unico e inalienabile. Ciò implica anche il rispetto dell’ambiente naturale e di altri esseri viventi che fanno parte dell’ecosistema umano e un approccio sostenibile che consenta alle generazioni future di prosperare.”[5]

Così, nelle Proposte per una strategia italiana per l‘intelligenza elaborate dal Gruppo di Esperti MISE sull’intelligenza artificiale si può leggere che :

“L’antropocentrismo della strategia italiana deve riflettersi in politiche adeguate finalizzate all’uomo in quanto persona, lavoratore, cittadino, consumatore e utente. Tale approccio si riflette nelle politiche sociali, nel contrasto alle diseguaglianze e alle discriminazioni, nelle politiche in tema di istruzione e formazione, nella modernizzazione della PA, nel finanziamento alla ricerca e nella legislazione a protezione del consumatore e dell’utente, sia offline che online.”[6]

Un’intelligenza artificiale complementare – piuttosto che sostitutiva – all’intelligenza umana permetterebbe di garantire il rispetto dei valori fondamentali e dei principi.

Così, orientamenti elaborati dal gruppo di esperti ad alto livello sull’IA[7] hanno messo in luce che per ottenere una IA affidabile sarebbero necessari tre presupposti:

- l’IA dovrebbe rispettare la legge,

- dovrebbe osservare i principi etici e

- dovrebbe dimostrare robustezza.

Per riscontrare il rispetto di questi tre parametri, sono stati individuate sette presupposti valutativi che potremmo definire una “check list di controllo” che richiede il soddisfacimento dei seguenti requisiti:

- intervento e sorveglianza umani, che assicurino un utilizzo dei sistemi di IA conforme ai diritti umani fondamentali garantendo pertanto la sorveglianza umana finalizzata a mettere al centro di ogni sistema il benessere dell’utente

- robustezza tecnica e sicurezza, da intendere come sicurezza e affidabilità degli algoritmi e come resilienza dei sistemi contro possibili operazioni illecite

- riservatezza e governance dei dati, che richiede pertanto un approccio di data protection fin dalla progettazione dei sistemi IA

- trasparenza, garantendo la tracciabilità dei sistemi e la capacità di dimostrare il funzionamento del processo decisionale dell’algoritmo

- diversità, non discriminazione ed equità, evitando che gli algoritmi possano essere inficiati da condizionamenti storici involontari, incompletezza e modelli di governance inadatti

- benessere sociale e ambientale, considerando pertanto l’impatto sull’ambiente e sull’assetto sociale, incoraggiando l’utilizzo dell’IA laddove il suo utilizzo possa favorire uno sviluppo sostenibile

- accountability, attraverso una continua verificabilità interna o esterna dei sistemi, con particolare riferimento a quelli che impattano su diritti fondamentali, individuando, analizzando e riducendone al minimo i possibili impatti negativi

Il passo successivo: uniformità normativa

Tuttavia la ricerca effettuata per il conto del Parlamento europeo evidenzia la mancata chiarezza nelle formulazioni delle linee guida. Thomas Metzinger, membro del gruppo di esperti della Commissione sull’intelligenza artificiale, ha avvertito che “le linee guida sono minimaliste, volutamente vaghe e non prendono in considerazione i rischi a lungo termine”.[8] Una criticità emersa è anche la mancanza di gerarchia tra i principi che avrebbe permesso alle istituzioni europee di personalizzare il loro approccio politico.

Un altro aspetto da considerare è la natura non vincolante delle linee guida e l’inesistenza di un controllo della loro attuazione, creando quindi pochi incentivi alla concreta applicazione di questi principi etici. Così, la mancanza di supervisione normativa solleva la questione del conferimento di poteri agli enti pubblici o alle autorità per monitorare l’applicazione delle linee guida etiche dell’UE.

In ultimo ma non per ultimo vi è da considerare la possibile frammentazione del panorama europeo in materia di intelligenza artificiale. Diversi Stati membri infatti hanno già messo in atto legislazioni nazionali relativi a principi etici dell’intelligenza artificiale in parallelo alle iniziative europee. Tale frammentazione potrebbe ostacolare la creazione di servizi europei di IA.

Conclusioni

Attraverso il contributo reso dalla Commissione e dal Parlamento europeo, l’Unione europea ha fatto emergere la stringente necessità di elaborare orientamenti etici in materia di IA. Lo sviluppo dell’IA prescindendo dall’applicazione di questi principi rischia di tradursi nel definitivo asservimento dei diritti e delle libertà dell’individuo al dirompente sviluppo della tecnologia, e non anche il contrario.

Per tale motivo tra i progetti della Commissione troviamo lo sviluppo di una serie di reti di centri di eccellenza per la ricerca sull’IA, la creazione di reti di poli dell’innovazione digitale incentrati sull’IA per le attività produttive e sui big data; l’avvio di discussioni preparatorie per sviluppare e attuare un modello per la condivisione dei dati e per utilizzare al meglio gli spazi di dati comuni, in particolare nei settori dei trasporti, dell’assistenza sanitaria e della produzione industriale[9].

A ciò si aggiunga che il tema dell’intelligenza artificiale subisce una forte compenetrazione con i principi di data protection di cui al GDPR 679/2016. Pertanto, alla luce della diretta applicabilità in tutti gli Stati membri della fonte regolamentare, e della uniformità legislativa garantita in materia di protezione dati anche grazie all’ingente lavoro interpretativo svolto dall’EDPB (european data protection board), si rivelano essenziali, oltre a orientamenti comuni, anche veri e propri interventi normativi anche in materia di IA coordinati a livello europeo e nazionale per garantire un’armonizzazione coerente delle linee guida innanzi richiamate ed evitare pertanto possibili divergenze applicative all’interno dell’UE.

_______________________________________________________________________

- C. Castelli D. Piana, “Giustizia predittiva. La qualità della giustizia in due tempi”, Questione giustizia – Fascicolo 4/2018, http://questionegiustizia.it/rivista/2018/4/giustizia-predittiva-la-qualita-della-giustizia-in-due-tempi_589.php. ↑

- L’etica dell’intelligenza artificiale, Il Post, 12 aprile 2017 ↑

- Massimo Valeri, “Decisioni automatizzate, quale difesa da chi ci discrimina via algoritmi”, Agenda Digitale, https://www.agendadigitale.eu/sicurezza/privacy/decisioni-automatizzate-quale-difesa-da-chi-ci-discrimina-via-algoritmi/. ↑

- Comunicazione della Commissione al Parlamento europeo, al Consiglio, al Comitato economico e sociale europeo e al Comitato delle regioni, COM(2019), “Creare fiducia nell’intelligenza artificiale antropocentrica”, https://eur-lex.europa.eu/legal-content/IT/TXT/PDF/?uri=CELEX:52019DC0168&from=EN, p. 6. ↑

- Nathalie Smuha, “Orientamenti etici per un’IA affidabile”, Gruppo di esperti ad alto livello sull’intelligenza artificiale, p. 46. ↑

- Gruppo di Esperti MISE sull’intelligenza artificiale, Proposte per una strategia italiana per l‘intelligenza artificiale, https://www.mise.gov.it/images/stories/documenti/Proposte-per-una-strategia-italiana-2019.pdf, p. 79. ↑

- Ci si riferisce al lavoro svolto di concerto tra il Gruppo europeo sull’etica nelle scienze e nelle nuove tecnologie (GEE) e dall’Agenzia dell’Unione europea per i diritti fondamentali (FRA) ↑

- Tambiama Madiega, “EU guidelines on ethics in artificial intelligence: Context and implementation”, EPRS | European Parliamentary Research Service, https://www.europarl.europa.eu/RegData/etudes/BRIE/2019/640163/EPRS_BRI(2019)640163_EN.pdf, pp. 5-6. ↑

- Gruppo di Esperti MISE sull’intelligenza artificiale, Proposte per una strategia italiana per l‘intelligenza artificiale, https://www.mise.gov.it/images/stories/documenti/Proposte-per-una-strategia-italiana-2019.pdf ↑