In questo momento di emergenza da coronavirus, al rischio “sanitario” si unisce pericolosamente il rischio “sociale e della fiducia” alimentato da vere e proprie pandemie informative che “infettano” uno dei più importanti fattori della gestione della crisi: la corretta comunicazione dell’emergenza.

Vediamo quindi come il disturbo delle informazioni e le fake news stanno caratterizzando l’attuale emergenza da coronavirus per tentare di comprenderne la portata e le strategie a contrasto messe in atto.

Indice degli argomenti

Il virus della disinformazione

La disinformazione colpisce tutti ovunque. Contribuisce a rendere l’ecosistema mediatico un ambiente in cui la narrazione prende il sopravvento sull’informazione. I contenuti e la tecnica narrativa prevalgono sulla veridicità dei fatti che descrivono.

Per usare una bella definizione dell’economista Leonardo Becchetti, Professore ordinario di Economia politica presso l’Università di Roma Tor Vergata, “la deformazione della realtà nel rimbombo degli echi e dei commenti della comunità globale su fatti reali o spesso inventati”, nell’attuale contesto emergenziale costituisce un problema enorme dalle conseguenze rilevanti.

La creazione e la condivisione involontaria (misinformazione) o deliberata (disinformazione) di informazioni false e non dimostrate, aumentano, si trasmettono più pervasivamente e molto più velocemente della verità online.

Ne sono esempi i contenuti virali assurdi o le informazioni spesso complottistiche, stile QAnon, circolate in rete nell’ultimo periodo e del tutto destituite di qualsiasi elemento probatorio o fondamento scientifico e logico.

Gli esempi di recenti fake news “geopolitiche” sul coronavirus

L’elenco che segue riporta meri esempi di contenuti non attendibili e fake tratti dal web.

- Il Coronavirus è stato creato da una “congrega” di miliardari che vogliono dare vita ad un nuovo ordine mondiale. Così Paolo Barnard su Twitter. E la catena dei twitter continua.

- “Il Coronavirus, nome in codice Wuhan-400, è un’arma batteriologica creata dalla Cina che realizza una “profezia” preannunciata in un libro del 1981”. Una “fake news” che allude al racconto di fantasia dello scrittore statunitense Dean Koontz nel libro The Eyes of Darkness, uscito appunto quarant’anni prima. Alcune testate peraltro ne hanno evidentemente subito il fascino stante che ne hanno di fatto agevolato la diffusione, riportando il contenuto di un’intervista video rilasciata ad un sito che si occupa di geopolitica e affari internazionali, da un noto professore di diritto presso l’Università dell’Illinois il quale sosteneva che il coronavirus fosse “un’arma da guerra biologica potenzialmente letale (…) fuoriuscita da un laboratorio di massima sicurezza” di Wuhan.

- “Il Coronavirus, nome in codice Gorki-400, è un’arma batteriologica creata (questa volta) dall’Unione Sovietica”. Per alludere in questo caso al nome dato al virus letale nella versione originale del 1981 del medesimo libro The Eyes Of Darkness. Nel libro, il virus proveniva dalla Russia ed era chiamato “Gorki-400” dalla città in cui fu creato.

- O perché no, il Covid-19 viene ritenuto un’arma sviluppata dagli Stati Uniti. A gennaio un sito russo pubblicò un articolo in tal senso. Ed è noto che una tra le più virali quanto non dimostrabili teorie della cospirazione vi sia anche quella che vede Bill Gates artefice della diffusione intenzionale del virus.

- Il Covid-19 è l’inizio dell’apocalisse con giudizio divino ormai prossimo. “Tra le cose più belle della Bibbia ci sono le sue profezie: è uno dei modi che utilizza Dio per guadagnarsi la nostra fiducia. Le profezie che si avverano dimostrano alle persone che ci si può fidare della Bibbia”. Così l’introduzione di uno dei tanti video postati sui social network, caricati dagli influencer della cristianità.

E ancora: “Nonostante gli sforzi del mondo della medicina, oggi insorgono nuove malattie ed epidemie. Il coronavirus di Wuhan è solo uno degli esempi che la profezia della fine dei tempi si sta avverando». «I media hanno contribuito a trascinare le persone nella paura del coronavirus. Gesù dice: “Non abbiate paure”. Questa epidemia doveva scoppiare, l’ha predetta Dio, ed è il segno che Gesù sta per arrivare. Vi faccio un appello: siate più preoccupati della vostra salute spirituale che del coronavirus”. Melvin Sandelin, il cui canale YouTube The Christian Life conta circa 80.000 iscritti in gran parte “fedeli”.

- Oppure, il Coronavirus è dipeso dalla tradizione culinaria cinese e dai pipistrelli in particolare. Sono divenute virali le affermazioni di Luca Zaia del febbraio scorso, che richiamano una altrettanto nota leggenda metropolitana: “li abbiamo visti tutti mangiare topi vivi”. L’effetto che hanno sortito è stato abbastanza impattante, nonostante l’immediata rettifica con tanto di scuse ufficiali all’ambasciata cinese rese dallo stesso e volte a specificare come l’affermazione mirasse al contrario ad evidenziare la “montagna di materiale e video, molti dei quali fake, che pesano sulla reputazione di questo virus”.

Più di ogni altra fake ha pesato in funzione antisionista e discriminatoria l’assurda teoria per la quale il Covid-19 si sarebbe sviluppato dalla zuppa di pipistrello e dalle abitudini culinarie cinesi.

Come, perché e da chi vengono diffuse le fake news

Di fatto, come in tutti i suddetti esempi, la maggiore probabilità che gli individui “diffondano il contenuto falso, non dimostrato o fuorviante postato da altri” più della verità, è ciò che guida la diffusione di notizie false consentendogli di proliferare, nonostante la rete e i singoli fattori che favoriscono la verità.

Malgrado, inoltre, molte inchieste e rapporti (specie statunitensi) in fatto di disinformazione, abbiano reso evidente il ruolo dei robot nella diffusione delle fake news, tuttavia, altrettanti studi scientifici dimostrano che, in realtà, è il comportamento umano che contribuisce maggiormente alla diffusione differenziale di falsità e verità.

Ciò implica che, esattamente come per la crisi epidemiologica in atto, la giusta comprensione di come le “fake news”, ed i contenuti virali che ad esse si accompagnano, si diffondono, sia il primo passo per contenerle e per mettere in atto azioni anche comportamentali efficaci.

First Draft, la famosa organizzazione no profit globale che supporta giornalisti, accademici e tecnici nelle sfide relative alla fiducia e alla verità nell’era digitale e Claire Wardle, la sua direttrice esecutiva ci suggeriscono un metodo di analisi interessante.

L’ecosistema informativo secondo Wardle può essere analizzato a partire dalla sua scomposizione in tre elementi fondamentali:

- I diversi tipi di contenuto che vengono creati e condivisi

- Le motivazioni di chi crea questo contenuto

- Le modalità di diffusione di questo contenuto

I diversi tipi di contenuto che vengono creati e condivisi

Quanto al primo punto, i contenuti fake relativi al Covid-19 possono essere di vario tipo.

- Contenuti appartenenti al mondo dei media tradizionali: giornali, servizi televisivi, opuscoli.

Tra questi, le breaking news o notizie dell’ultimo minuto ed esclusive si stanno rivelando uno dei modi più efficaci per veicolare disinformazione. La logica dello scoop attrae molti giornalisti, ma spesso è foriera di problematiche piuttosto rilevanti: l’esigenza di tempestività contrasta con la necessaria verifica della veridicità. Le “voci” si mischiano ai fatti. Alcuni esperti tra cui Michael Golebiewski ricercatore della Microsoft e Program Manager per Bing parla in tal senso di un problema che definisce “data void”. Un “vuoto” di informazioni provocato dalle query dei motori di ricerca che danno risultati scarsi o assenti soprattutto quando la stringa di ricerca è piuttosto nebulosa o inusuale. I data void con facilità vengono sfruttati da manipolatori della disinformazione.

Anche il click-baiting è una tecnica giornalistica che ben si presta a tattiche di disinformazione poiché prevede l’utilizzo di titoli sensazionalistici, a volte uniti ad immagini in evidenza create apposta per colpire e catturare l’attenzione o diffondere atteggiamenti allarmistici.

E’ recente la notizia che proprio in questi giorni in Italia l’AIAV, Associazione Italiana Agenti di Viaggi, ha dato mandato a un avvocato penalista del Foro di Pescara, di agire con denuncia-querela nei confronti di alcune note testate giornalistiche italiane per l’accertamento di reati connessi all’aver “diffuso e procurato allarme sociale con titoli di prima pagina e articoli dai contenuti ben lontani dalla verità”. E non solo, l’ AIAV ha infatti inviato formale diffida a CODACONS, chiedendo l’immediata cessazione della diffusione di quelli che ritiene essere messaggi volti ad illudere i consumatori-viaggiatori sulla possibilità di annullare qualsiasi viaggio o vacanza senza doverne pagare le conseguenti penali, adducendo quale motivazione la preoccupazione per il diffondersi del coronavirus.

Ovviamente il problema non è solo italiano. Anzi. La dimensione è assolutamente globale. Molte analisi recenti, tra cui quella del DfrLab, hanno mostrato come numerosi articoli di testate di varia natura ed origine, spesso russa, alludano esplicitamente al coronavirus come arma per una guerra commerciale ed economica contro i rivali cinesi. E a quanto pare non ne sono esenti neppure i media tradizionali “vicini alle istituzioni” che anzi fanno proprie le dichiarazioni avvenute in tal senso da esponenti politici delle varie fazioni amplificandone la visibilità.

Direi che fanno parte di questa tipologia di contenuti anche molte delle numerose animazioni e “infografiche” sulla diffusione dei contagi, il numero di morti o la velocità di diffusione del virus. Spesso alla grafica accattivante non si accompagna la giusta trasparenza ed il necessario rigore sulla descrizione dei criteri utilizzati per le analisi statistiche.

- Contenuti virali appartenenti agli ambienti dell’ecosistema web e social: post su piattaforme social, articoli, blog, messaggi privati su chat o gruppi social tipo WhatsApp, “meme”, video fake, fake audio; fino ai contenuti tecnologicamente complessi come i deepfakes o le false discussioni alimentate tramite botnet preconfezionati per incrementare traffico di rete su un hashtag pilotati.

Non è un caso che in numerosi post social, agganciato all’hashtag #coronavirus frequentemente si trovino uniti termini riconducibili a teorie complottistiche mondiali #cospiracy e forme di censura prettamente cinese incidenti sulla reale entità del virus #censorship.

Ne fanno parte i contenuti reali accompagnati però a informazioni contestuali false, quelli spacciati come derivanti da fonti autorevoli che invece sono false oppure non credibili; i contenuti contraffatti con tecniche di editing multimediale, i contenuti semplicemente satirici o quelli gravemente falsi “fabbricati per distribuire fatti e creare allarmismo”.

E dunque:

- false informazioni sulle cure;

- false informazioni su dove vengono scoperti nuovi casi;

- immagini o video che mostrano presumibilmente persone ammalate o decedute per il coronavirus;

- false informazioni sull’origine del virus.

Le fake news social/whatsapp sul coronavirus

Ne sono chiari esempi questi tratti dal web nel’ultimo periodo:

- La minestra d’aglio può farci guarire dal coronavirus. Falso

- Attenzione alle lettere e ai pacchi infetti provenienti dalla Cina. Falso

- Una delle catene circolate su WhatsApp faceva riferimento al testo attribuito ad un’ematologa del sito ALT, una onlus di Milano che si occupa di prevenzione della trombosi e altre malattie cardiovascolari, e riportava “assurdi” consigli di prevenzione suggeriti da un fantomatico “giovane ricercatore” che da Shenzhen si è trasferito a Wuhan per – così si legge “collaborare con la task force che sta combattendo contro l’epidemia da Coronavirus”. Falso

- Il tenore di alcuni dei bizzarri consigli riportanti anche sintomi distorti del virus e cure pseudo-miracolose è il seguente: “Il virus non resiste al calore e muore se esposto a temperature di 26-27 gradi: quindi consumate spesso durante il giorno bevande calde come the, tisane e brodo, o semplicemente acqua calda: i liquidi caldi neutralizzano il virus e non è difficile berli. Evitate di bere acqua ghiacciata o di mangiare cubetti di ghiaccio o la neve per chi si trova in montagna (bambini)”. O anche: “Il corona virus è piuttosto grande (diametro circa 400-500 nanometri), quindi ogni tipo di mascherina può fermarlo: non servono, nella vita normale, mascherine speciali. Diversa è invece la situazione dei medici e dei sanitari che sono esposti a forti cariche del virus e devono usare attrezzature speciali”. Falso

- Su YouTube, Jordan Sather, uno degli altri autori social di post “complottisti” ha annunciato ai suoi numerosi seguaci che “il coronavirus fosse una nuova malattia pianificata a tavolino per aiutare le case produttrici di vaccini”. Falso

Allo stesso modo, su Facebook, non è difficile imbattersi in diversi Gruppi peraltro pubblici come “QAnon QClearance 8chan + related articles 2 Staqe 2” densi di contenuti e video “ingannevoli”

Questa immagine del CDC, uno dei principali componenti operativi del Dipartimento della salute e dei servizi umani in America:

L’app di condivisione di video brevi, TikTok, è stata tra quelle particolarmente attive in ambito Covid-19, con numerosi post di disinformazione. Uno di questi ha avuto circa 2,4 milioni di visualizzazioni prima di essere rimosso.

Che dire poi di quei post divulgativi di finti consigli medici con finalità preventive e addirittura curative.

- “Ingerire biossido di cloro può aiutare ad annientare il virus”.

- “Le maschere chirurgiche proteggono dal Covid-19”.

- “I prodotti a base di argento colloidale proteggono dalle infezioni del coronavirus”.

- Alcuni sono arrivati a scrivere che “il coronavirus modifica il colore del sangue umano” o che “strofinare l’olio di sesamo sulla pelle potrebbe bloccare il coronavirus”. Tutto falso

E altri altrettanto assurdi.

Molti di questi contenuti sono stati opportunamente smentiti dal team EPI-WIN, il programma dell’agenzia delle Nazioni Unite – abbreviazione di WHO Information Network for Epidemics, che si occupa della divulgazione di informazioni accurate e puntuali derivanti da fonti attendibili. Lo ha fatto attraverso specifiche infografiche piuttosto efficaci, anche se forse non altrettanto virali rispetto ai contenuti fake che intendono rettificare.

Le motivazioni di chi crea contenuti disinformativi

Relativamente al secondo punto della classificazione di Wardle, sulla comprensione delle motivazioni alla base della creazione dei contenuti disinformativi, è sicuramente interessante la classificazione che la stessa riconduce in parte alle intuizioni di Eliot Higgins fondatore e direttore esecutivo del gruppo investigativo-giornalistico Bellingcat con sede a l’Aia, nei Paesi Bassi.

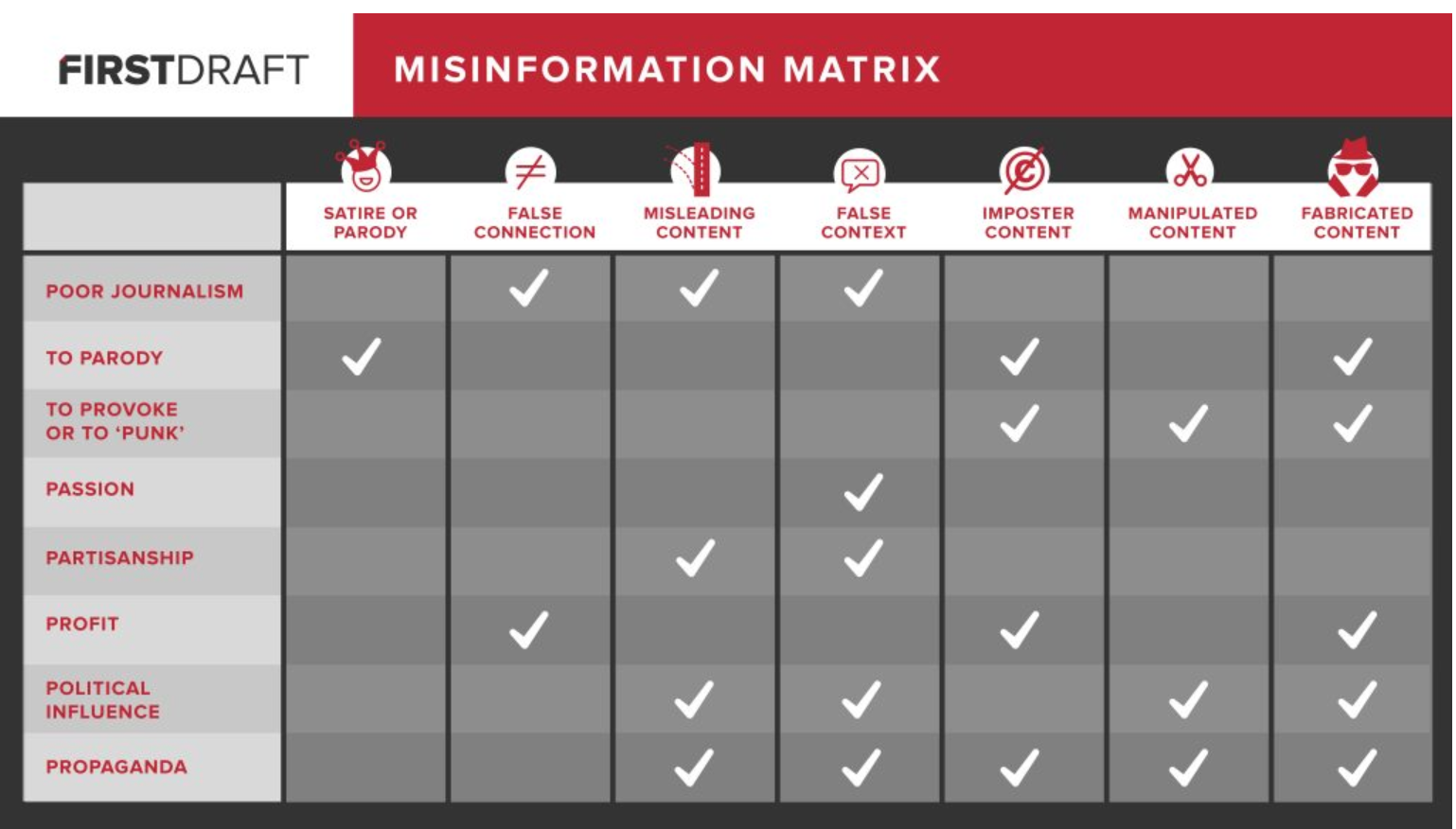

Esattamente, Claire Wardle elabora uno schema che incrocia 7 modi di fare disinformazione con 8 possibili motivazioni “Poor Journalism, Parody, to Provoke or ‘Punk’, Passion, Partisanship, Profit, Political Influence or Potenza e Propaganda”.

Fonte Immagine: https://firstdraftnews.org/latest/fake-news-complicated/

- Cattivo giornalismo

- Semplice parodia

- Provocazione o presa in giro

- Interesse particolare

- Faziosità

- Profitto

- Influenza Politica

- Propaganda

L’intento della matrice è piuttosto evidente: analizzare e comprendere le motivazioni alla base dei vari contenuti può aiutare a combattere la diffusione delle fake news a cominciare proprio dalla corretta individuazione delle aree di indagine per tipologia di contenuti fuorvianti prescelti.

Le modalità di diffusione delle fake news

Il terzo punto della scomposizione dell’ecosistema informativo, relativo invece all’analisi delle modalità attraverso le quali vengono distribuite le fake news, può essere utile per comprendere la portata “virale” dei contenuti ed esaminarne i punti di propagazione. Capire come si diffondono le notizie false è infatti un primo passo verso la relativa riduzione.

Le tecniche della manipolazione sono in realtà già abbastanza note ai più attenti e tutte si basano su strategie di microtargeting di natura psicografica ed emozionale. “Trollare” è un termine altrettanto comune in tali contesti, e anche molto efficace, specie se frutto di vere e proprie troll-farm.

E in tutto ciò i social network, hanno assunto un ruolo abilitante del disturbo dell’informazione di prim’ordine. Un recente studio del Pew Center indica che una larga percentuale di persone si informa più dai social media che da qualsiasi altra fonte. Vale per i millennial, in particolar modo anche se gli adulti non ne sono immuni.

Wardle descrive l’effetto indotto dai social media come un fenomeno di atomizzazione delle notizie.

“Atomi” di contenuti virali sono diretti in modo mirato ad alcuni utenti che, una volta ri-condiviso in un social network il medesimo contenuto ingannevole attivano reti di fiducia tra gli utenti in reciproco contatto che uno a uno o uno a tanti, rimbalzano la notizia in modo estremamente veloce e pervasivo.

Secondo un recente studio del MIT, le notizie false hanno il 70% in più di probabilità di essere ritwittate rispetto alle storie vere, con la verità che viaggia sei volte più lentamente della menzogna.

Chiamano questo fenomeno “effetto cascata” ovvero catene ininterrotte di “retweet” che a quanto pare, al momento, favoriscono la proliferazione delle fake news grazie a fattori quali la novità della notizia e l’attitudine a toccare “sfere emozionali sensibili” come paura, disgusto e sorpresa. La loro ricerca, pubblicata sulla rivista Science , ha scelto di basarsi sul social Twitter esaminando la diffusione di notizie vere e false pubblicate sul social dal 2006 al 2017.

L’immagine è tratta dallo Studio del MIT.

E ai contenuti “rilanciati” dagli utenti comuni si aggiungono quelli veicolati dai vari gruppi di influenza sul social, quelli generati dalle reti di bot e fabbriche di troll e non ultimi quelli amplificati dai giornalisti.

“Quando vediamo più messaggi sullo stesso argomento, finiamo per credere a quelli ai quali siamo più esposti” spiega Wardle. “Deve essere vero, diciamo. L’ho visto così tante volte!”

Il problema chiaramente si amplifica ulteriormente quando utenti esperti o autorevoli, a partire dai politici, prestano più o meno consapevolmente “il fianco” alla cattiva informazione.

Negli Stati Uniti, il presidente Donald Trump è spesso uno dei protagonisti in tal senso, ma senza dubbio è in ottima compagnia: Solomon Yue un dirigente sino-americano del Partito Repubblicano ha twittato un post “complottista” a oltre 100.000 follower sostenendo che il virus fosse stato rubato dal Canada per essere usato come arma biologica. Altrettanto Jim Banks, un politico statunitense, membro della Camera dei Rappresentanti per lo stato dell’Indiana.

“La disinformazione durante le epidemie di malattie infettive potrebbe rendere più gravi questi focolai” scrive Julii Brainard.

“La cosa che preoccupante, è che è più probabile che le persone condividano cattivi consigli sui social media, piuttosto che buoni consigli da fonti fidate” Paul Hunter

Il professor Paul Hunter, esperto del COVID-19, e il dott. Julii Brainard, entrambi dell’East Anglia, sono gli autori di uno studio estremamente interessante sugli effetti della condivisione di informazioni pericolosamente errate sulla salute umana in contesti epidemiologici.

Le loro conclusioni evidenziano con rigore scientifico e lucidità come la circolazione di contenuti fuorvianti durante un’epidemia contribuisca a rendere l’epidemia più grave e come al contrario ridurne la quantità potrebbe mitigarne l’effetto negativo. Hanno usato la tecnica della simulazione per provare le loro analisi che a loro volta hanno potuto basarsi sui dati reali relativi alle influenze norovirus e monkeypox.

I loro risultati sono stati presentati per la prima volta ad una conferenza sulla salute pubblica del Regno Unito nel 2018 ma sono stati nuovamente pubblicati di recente sulla rivista Revue d’Épidémiologie et de Santé Publique e sono disponibili per la consultazione. Consigliata.

Che fanno Google, Facebook, TikTok, Twitter (e altri) contro la disinformazione

Per contrastare la disinformazione, ‘OMS, sta chiedendo anche la collaborazione di Google, Apple, Twitter, Facebook, Pinterest, TikTok e altre aziende digitali cinesi come Baidu, Tencent e Weibo. E anche Instagram e YouTube, tra gli altri.

“Chiediamo loro di filtrare le informazioni false e di promuovere informazioni accurate da fonti credibili come l’OMS, il CDC e altri. E li ringraziamo per gli sforzi compiuti fino ad ora”, ha affermato il dott. Tedros Adhanom Ghebreyesus, direttore generale dell’OMS. “All’OMS, non stiamo solo combattendo il virus; stiamo anche combattendo i troll e i teorici della cospirazione che spingono la disinformazione.” “In sostanza, per combattere il diluvio di disinformazione, stiamo costruendo una banda di rivelatori di verità che disperdono i fatti e sfatano i miti. “

Una strategia di contrasto che non convince totalmente Nicoletta Corrocher, docente di Economia dell’Innovazione alla Bocconi di Milano che, sulla pagine web Open Innovation della Regione Lombardia, riferisce “(…)La soluzione insomma non può essere quella di limitare la circolazione delle informazioni, ma si deve intervenire sulla qualità dei contenuti. Su questo fronte, personalmente non credo che si debba delegare ai gestori delle piattaforme digitali il controllo di tale qualità. Significherebbe dare loro un potere enorme: chi stabilisce cosa è fake news o cosa no? Piuttosto, sono le istituzioni a dover intervenire, portando sulle sociali informazioni corrette”. “Qui sta il nodo. Le istituzioni, in questo caso quelle sanitarie e quelle politiche in particolare, devono imparare a stare di più e meglio sui social media. Che ci piaccia o meno è qui che la maggior parte delle persone oggi si informa. E invece, chi ha visto i post dell’OMS (Organizzazione Mondiale della Sanità)? O quelli dell’Istituto Superiore di Sanità? Addirittura, a volte ci siamo trovati di fronte all’assenza di propri profili social, anche se Twitter e soprattutto Facebook sono piattaforme che esistono da molti anni. Oltretutto, è chiaro che non ci si può limitare a rispondere a una fake news con una good news: la prima ha una forza molto maggiore. La questione dunque va affrontata a monte”. E ancora: “Un’educazione digitale dovrebbe essere parte strutturale dei programmi di studio, almeno dalle scuole medie inferiori”.

Nella medesima intervista Nicoletta Corrocher propone delle soluzioni alternative che sono senza dubbio meritevoli di attenzione. Tra queste, incentivare – anche finanziariamente – e sviluppare competenze trasversali e a lungo termine attraverso un’educazione digitale che inizia tra i banchi di scuola.

Per Bhaskar Chakravorti, Decano del Global Business presso la Fletcher School, Tufts University e Direttore esecutivo dell’Institute for Business, in ogni caso, non esiste un proiettile d’argento contro la disinformazione sanitaria. Lo stesso, negli ultimi dieci anni, ha potuto monitorare l’effetto della tecnologia digitale su questioni come la salute globale e lo sviluppo economico. Un post fuorviante sul coronavirus può semplicemente “saltare le piattaforme”, dice. “Quindi potresti avere Facebook che cancella un post, ma poi il post si fa strada su Twitter, quindi passa da Twitter a YouTube.”

Le piattaforme digitali hanno risposto all’appello dell’OMS applicando di fatto varie restrizioni indirizzate contro le applicazioni ritenute non affidabili perché non certificate da enti istituzionali o di ricerca riconosciuti.

“Le app con le informazioni mediche attuali devono essere presentate da un’istituzione riconosciuta” riferisce Apple. E Google si muove sulla stessa linea: restrizioni e controlli su quei contenuti che “mancano di ragionevole sensibilità o capitalizzano su disastri naturali, atrocità, conflitti, morti o altri eventi tragici”, e che paiono voler “trarre profitto da un evento tragico senza benefici evidenti per le vittime”

Stando alle dichiarazioni su Twitter del 30 gennaio scorso BigG lo farà avvalendosi di quello che chiama “SOS Alert”

- Twitter, da parte sua sceglie di concentrarsi su fonti ufficiali quali l’OMS e il CDC nei risultati di ricerca tramite il termine “coronavirus”. In un post di fine gennaio Twitter ha riferito di aver assunto provvedimenti per garantire che la piattaforma fosse protetta da “comportamenti dannosi” e che avrebbe rimosso gli account coinvolti in tali comportamenti. Ha cominciato di fatto con quello di Zero Hedge il quale aveva diffuso una strana teoria che incolpava senza dimostrarlo uno scienziato cinese di aver creato COVID-19. Pare che la pagina avesse addirittura pubblicato online le informazioni di contatto personali dello scienziato, una pratica nota come doxing, che incita altri a mettersi in contatto con il malcapitato.

- Facebook analogamente riferisce “Quando le persone cercano informazioni relative al virus su Facebook, si attiverà un pop-up educativo con informazioni attendibili multilingue”. Un portavoce del social riferisce “Abbiamo pensato di collegare le persone ai relativi Ministeri sanitari regionali di diversi paesi, ad esempio: il Centro per la protezione della salute a Hong Kong, il Centro per il controllo delle malattie di Taiwan, il Dipartimento della salute della Repubblica delle Filippine nelle Filippine, il Ministero della salute in Italia.”

Ha inoltre vietato nella sua piattaforma la pubblicità di prodotti che affermavano arditamente di curare o prevenire Covid-19 e Zuckerberg in prima persone si è a impegnato a fornire all’OMS “tutte le pubblicità gratuite di cui hanno bisogno”, nonché “milioni di crediti pubblicitari in più ad altre organizzazioni”.

- Stessa logica per Instagram che sta bloccando o limitando gli hashtag utilizzati per diffondere la disinformazione attraverso popup mirato che in caso di ricerche basate su termini come “coronavirus” riportano alla pagina informativa dell’Organizzazione mondiale della sanità.

- Sotto i video a tema epidemia, YouTube, dell’universo Google, ha deciso di includere una dichiarazione di non responsabilità e un collegamento a Wikipedia se non anche alla pagina di informazioni dell’Organizzazione mondiale della sanità.

- E, come riporta anche il New York Times, gli utenti che cercano “coronavirus” su Pinterest sono reindirizzati ad una pagina che fornisce, in forma di immagini, tutte le informazioni utili in tema coronavirus; un’apposita pagina viene inoltre destinata alla “messa a nudo” delle principali leggende metropolitane che circolano sull’epidemia.

A breve pare saranno coinvolti anche Uber e Airbnb, e Amazon.

WhatsApp, Signal, iMessage e Telegram, essendo crittografati end-to-end, invece, mal si prestano a strategie mirate contro i contenuti fake virali. Diversamente, la cinese WeChat sembrerebbe mettere in atto diverse pratiche di moderazione sulle cui logiche però si potrebbe forse aprire un’ulteriore discussione.

Conclusioni: che possiamo fare tutti

L’impatto negativo della disinformazione sui contesti emergenziali specie riferiti alla salute è fuori da ogni dubbio. Tuttavia, non esiste un proiettile d’argento per combattere la disinformazione sanitaria. Ed è diventato “molto, molto difficile combattere efficacemente”, afferma Chakravorti, professore alla Tufts University e autore di “The Slow Pace of Fast Change: portare innovazioni sul mercato in un mondo connesso”.

E dunque cosa possiamo fare tutti?

“Una falsa notizia – scriveva nel 1921 lo storico Marc Bloch – nasce sempre da rappresentazioni collettive che preesistono alla sua nascita; essa solo apparentemente è fortuita o, più precisamente, tutto ciò che in essa vi è di fortuito è l’incidente iniziale, assolutamente insignificante, che fa scattare il lavoro dell’immaginazione; ma questa messa in moto ha luogo soltanto perché le immaginazioni sono già preparate e in silenzioso fermento”.

In altre parole, la nostra percezione e la nostra fiducia viene orientata dalle emozioni piuttosto che dalle prove. Desideriamo o temiamo così tanto che qualcosa accada o sia vero, da rifiutare l’evidenza del contrario. Terreno quanto mai fertile per i “manipolatori” dell’informazione ma anche insidioso per i semplici “ingenui” del web.

E un detto cinese spiega bene quanto esposto sopra: “due terzi di quello che vediamo è dietro i nostri occhi”.

La lotta alla disinformazione è dunque trasversale. È una sinergia da potenziare attraverso la costituzione di partnership affidabili dotate di conoscenze interdisciplinari e dove proprio il contributo offerto dalla tecnologia e dai protagonisti del web potrebbe rivelarsi quanto mai strategico. Attori come snopes.com, politifact.com, factcheck.org, truthorfiction.com, hoax-slayer.com e urbanlegends.about.com oltre alle piattaforme social possono dare un importante contributo.

È però anche un investimento culturale a lungo termine, da implementare a livello formativo a cominciare dalle scuole, teso allo sviluppo negli individui di approcci critici, ma non scettici, verso le informazioni che si ricevono:

- Consultare e confrontare più fonti di informazione

- Non condividere senza verificare

- Se capita di diffondere un contenuto falso, cercare di correggere velocemente e con la stessa enfasi

- Usare il pensiero critico

Sono solo alcune indicazioni di base.

È soprattutto una sfida che nel gravoso contesto epidemiologico emergenziale in atto va abilmente gestita, combinando il rigore della psicologia scientifica con la portata e la scala tecnologica di big data.